【2026年版】総務省の生成AIガイドライン解説|AIリスク4分類と社内ルールのサンプル

総務省やデジタル庁が発表している生成AIガイドラインの要点をビジネスパーソン向けに徹底解説。総務省が提唱する「AIリスク4分類」に基づく企業側の具体的な対応手順と、現場ですぐに使える社内利用ガイドラインのサンプルを整理しました。

生成AIの導入で情報漏洩や著作権侵害を防ぐ最大のポイントは、リスクの大きさに応じて管理レベルを変える「リスクベースアプローチ」を社内に定着させることです。本記事では、総務省やデジタル庁が公表している生成AIガイドラインを基に、安全なAI活用のための具体的な手順を解説します。政府の方針に沿った「AIリスク4分類」の評価手法や、企業が今すぐ使える社内利用ガイドラインのサンプルも取り上げます。基礎的な知識として プロンプトエンジニアリングの基礎 もあわせてご確認ください。

政府の生成AIガイドライン:基本方針と目的

企業がAI導入を進める上で、政府が策定した生成AIガイドラインを実務に落とし込むことは重要なステップです。総務省やデジタル庁が示しているガイドラインでは、生成AIの利活用促進とリスク管理を両立させることが明確な目的として掲げられています。

高リスクと判定されるAIの利活用であっても、一律に禁止するわけではありません。専門家によるアドバイザリーボードの助言を通じて、安全な実施をサポートする体制が構築されています。なお、教育現場におけるAI活用については、文部科学省の生成AIガイドライン解説や教育現場の活用事例も別途公開されており、分野ごとに具体的な指針の整備が進んでいます。

推進体制の構築として、組織内にAI統括責任者(CAIO)を設置することが求められます。CAIOは、部門横断的にAI導入のルールを策定し、運用状況を監視する役割を担います。現場の独自判断によるシャドーAIの利用を防ぐためにも、明確な責任の所在が必要です。

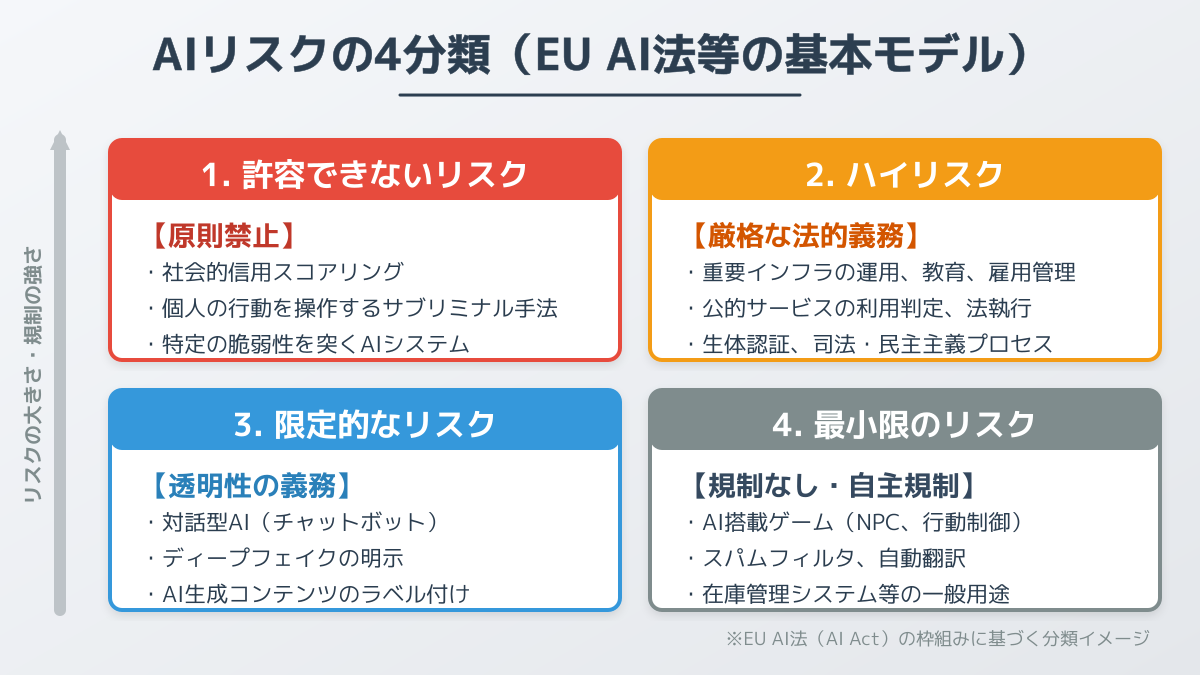

AIリスク4分類とは?評価軸と具体的な考え方

生成AIを社内導入する際、すべての利用を一律に制限するのではなく、リスクの大きさに応じて対応を変える「リスクベースアプローチ」が重要です。国際的な動向を見ると、EUのAI法ではAIを「許容できないリスク」「高いリスク」「限定的なリスク」「最小限のリスク」という4つに分類し、それぞれ異なる規制を課しています。

日本国内においても、デジタル庁の生成AIガイドラインで同様のアプローチが推奨されています。また、具体的な評価手法や管理体制の構築には、NIST AIリスク管理フレームワークから学ぶ企業向けの実践手順や、自社を守るAIリスクアセスメントと管理手順も併せて参考にしてください。具体的には、以下の4つの軸を用いてリスクを評価します。

- 利用者の範囲: 外部提供か内部利用か

- 業務の性格: 経営判断など重要な意思決定を伴うか、補助的な作業か

- データの機密性: 個人情報や機密性の高い営業秘密が含まれるか

- 人間による判断: 出力をそのまま利用するか、人間が最終確認を行うか

これらの軸を用いて自社の業務を分類することで、どこに重点的な対策を講じるべきかが明確になります。

企業が取るべき3つの対応策とセキュリティ管理

リスク評価を行う上で、生成AI特有の脅威を正しく理解し、企業として対応策を打つ必要があります。総務省と経済産業省が策定した「AI事業者ガイドライン」に基づき、以下の3つの対応策を徹底してください。

-

ハルシネーション(もっともらしい嘘)対策 生成AIが事実と異なる情報を出力するリスクを防ぐため、必ず人間の目で正確性を検証するファクトチェックのプロセスを組み込みます。ハルシネーションを防ぐ具体的な手法については、原因と誤出力を防ぐ5つのプロンプト事例や、「ハルシネーションしないでください」と指示するのが逆効果な理由と対策を参照してください。

-

情報漏洩・機密情報の保護 顧客の個人情報や未公開の財務データなどをAIに入力しないよう、明確な禁止事項を定めます。LLM(大規模言語モデル)の学習データとして自社データが二次利用されないように設定(オプトアウト)することも必須です。詳細は情報漏洩を防ぐ5つの対策と安全な導入ガイドラインを確認してください。

-

サイバー攻撃・プロンプトインジェクション対策 総務省が公表した「AIのセキュリティ確保のための技術的対策に係るガイドライン」では、LLMに細工をした入力を行って不正な出力を引き出す「プロンプトインジェクション攻撃」への技術的対策が推奨されています。セキュリティ体制を強化し、社内システムと安全に連携させる仕組みを構築します。

生成AI利用ガイドラインのサンプルと策定手順

総務省やデジタル庁の方針を実際の業務に落とし込むためには、システム側の技術的対策だけでなく、利用者側の運用ルールを社内ガイドラインとして明文化する必要があります。以下は、企業が導入時にそのまま活用できる「生成AI利用ガイドライン」の基本サンプルです。

【サンプル】生成AI社内利用ガイドライン(基本項目)

- 利用の目的と範囲

- 業務効率化(文章の要約、翻訳、アイデア出し等)を目的として、会社が許可した生成AIツールのみを利用すること。個人のアカウントや未許可のアプリ(シャドーAI)の業務利用は禁止する。

- 入力データの制限(機密保持)

- 顧客情報、個人情報、未発表の新製品情報、財務データなどの機密情報は、いかなる場合も生成AIに入力してはならない。

- 出力結果の検証(ファクトチェック)

- AIの出力結果にはハルシネーション(虚偽情報)が含まれる可能性があるため、業務に利用する際は必ず一次情報を確認し、人間が最終的な責任を持つこと。

- 著作権の保護

- 生成されたコンテンツを利用する際は、他者の著作権や商標権を侵害していないか確認すること。既存の作品と類似性が高い場合は利用を控える。

- 違反時の措置

- 本ガイドラインに違反し、情報漏洩等を引き起こした場合は、社内規定に基づく懲戒処分の対象となる場合がある。

現場のDX担当者は、このサンプルを基に、自社の業務特性(AIリスク4分類)に合わせて内容を調整し、全従業員へ周知徹底してください。

国際動向を踏まえたガバナンス体制の構築

総務省の生成AIガイドラインを実務に適用する上で、国際的な規制動向を踏まえたリスク管理態勢の構築も重要です。AIの進化に伴い、国内外で法規制の整備が進んでおり、企業は単にツールを導入するだけでなく、組織全体でガバナンスを効かせる仕組みが求められます。ガバナンス体制の構築手順については企業向けAIガバナンスのガイドラインと6つの手順を、さらに踏み込んだ国際基準についてはEUのAIガバナンス規制から学ぶ安全な導入ポイントを参考にしてください。

企業はガイドラインを一度読んで終わるのではなく、各国の法規制のアップデートに合わせて社内ポリシーを継続的に見直す体制を構築することが重要です。リスクを正しく分類し、それに応じた適切な管理基準を設けることで、初めて安全かつ効果的なAI活用が可能になります。

まとめ

本記事では、企業が生成AIを安全かつ効果的に活用するために不可欠な、総務省およびデジタル庁の生成AIガイドラインの主要ポイントを解説しました。政府が示すリスクベースアプローチの考え方を理解し、自社のAI利用実態に合わせた具体的なリスク管理体制を構築することが、生産性向上の鍵となります。

特に以下の点が重要です。

- AIリスク4分類 に基づき、業務ごとのリスクを正確に評価し、対策を講じること。

- 情報漏洩や知的財産権侵害を防ぐため、社内ガイドライン(サンプル活用)を策定し運用ルールを徹底すること。

- 国際的な規制動向を把握し、社内ポリシーを継続的に見直す体制を構築すること。

これらの要点を踏まえ、現場の反発を招かないよう適切にルールを整備し、安全な生成AIの業務活用を推進してください。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順

生成AI導入による情報漏洩やシャドーAIのリスクをどう防ぐべきか?社内のルール策定にお悩みのDX・IT担当者へ向け、経済産業省のAIガバナンスガイドラインの要点や、安全なプラットフォームを活用した6つの構築手順を具体的に解説します。AIガバナンスとは何かという基礎から、明日から使えるガイドラインのサンプル、現場の運用体制まで網羅した完全ガイド。

【2026年版】企業向けAIリスクマネジメント実践ガイド|自社を守るリスクアセスメントと管理手順

企業のAI活用に伴うリスクを可視化して対策する「AIリスクマネジメント」の全体像。自社で利用するAIツールに潜む危険性を評価するリスクアセスメントの具体的なステップと、継続的な管理体制の構築方法を解説します。

【2026年版】生成AIガイドライン(文部科学省)を解説|教育機関の導入手順とひな形サンプル

文部科学省の生成AIガイドラインを基に、大学などの教育機関がAIを安全に活用するためのポイントを解説します。情報漏洩や著作権侵害リスクを回避し、学問的誠実性を保つための独自ルールの作り方や、そのまま使えるガイドラインのひな形サンプルを紹介します。

【2026年版】AIガバナンス協会とは?専門家になるための資格・求人動向・必須スキル

企業のAI活用に伴うリスクを管理する「AIガバナンス」専門人材の需要が急増しています。本記事では、AIガバナンス協会が提唱する専門家への道筋や、実務で役立つ資格、最新の求人動向を具体的に解説。DX推進担当者がAIを安全に運用するための必携ガイドです。

EUのAIガバナンス規制とは?企業の事例から学ぶ安全な導入5つのポイント

世界で最も包括的とされるEUのAI規制(AI法)から学ぶ、グローバル基準のAIガバナンス体制の構築方法。国内企業の先進的な事例を交え、企業が押さえておくべき法規制トレンドと実践アプローチを解説します。

企業向けAIリスク教本|NIST AIリスク管理フレームワークを実践する4つの機能と5つの要点

AI導入のリスク管理でお悩みの担当者向けに、実践的な「AIリスク教本」として国際標準のNIST AIリスク管理フレームワークを分かりやすく解説します。AIリスクの4つのコア機能や5つの要点など、企業が安全にAIを活用するためのノウハウを網羅した入門記事です。