企業向けAIリスク教本|NIST AIリスク管理フレームワークを実践する4つの機能と5つの要点

AI導入のリスク管理でお悩みの担当者向けに、実践的な「AIリスク教本」として国際標準のNIST AIリスク管理フレームワークを分かりやすく解説します。AIリスクの4つのコア機能や5つの要点など、企業が安全にAIを活用するためのノウハウを網羅した入門記事です。

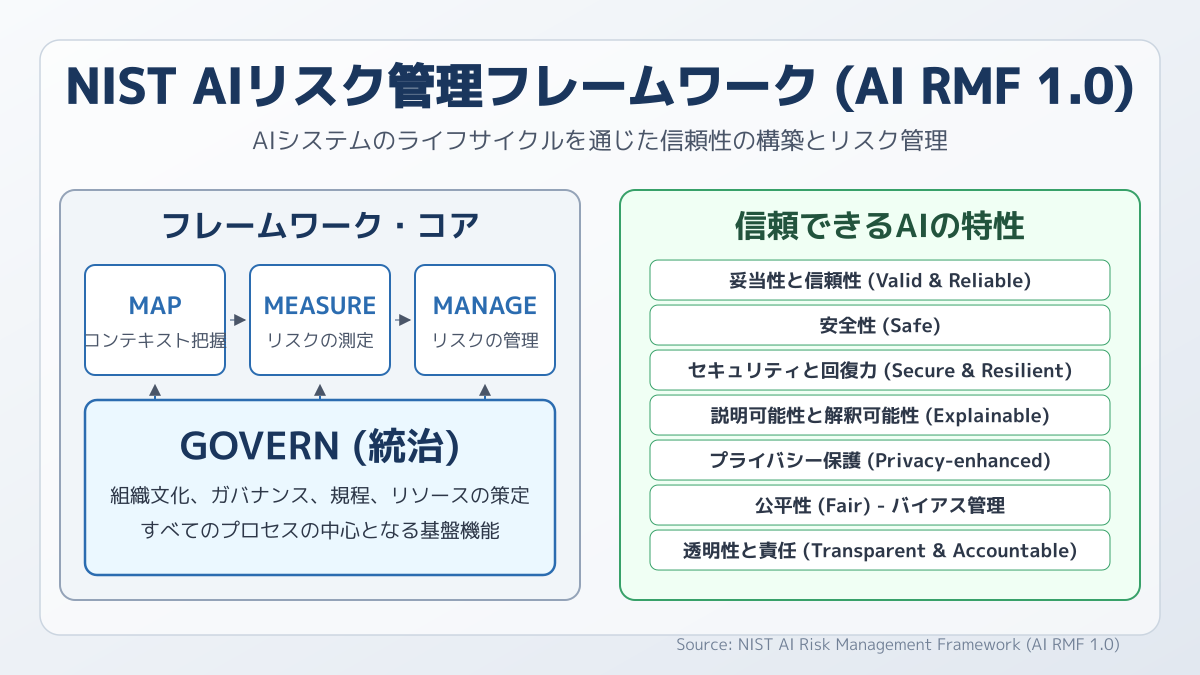

AI技術の急速な進化に伴い、企業は新たなリスクに直面しています。安全かつ効果的にAIを導入するには、体系的なリスク管理が不可欠です。本記事では、米国国立標準技術研究所(NIST)が提唱する「NIST AIリスク管理フレームワーク」を、企業のガバナンス担当者が読むべき実践的なAIリスク教本として解説します。このフレームワークが提示するAIリスクの4つのコア機能と5つの要点を理解することで、システムのリスクを特定し、継続的に管理するための具体的なアプローチがわかります。

NIST AIリスクマネジメントフレームワークとは?

米国国立標準技術研究所(NIST)が発行したNIST AIリスク管理フレームワーク(AI RMF)は、組織がAIシステムのリスクを自発的に管理するための国際的なガイドラインです。AI製品やシステムの設計から評価に至るまで、信頼性を組み込む能力を向上させることを目的としています。

このフレームワークの最大の特徴は、特定の技術や産業に依存しない汎用性の高さです。抽象的なAI倫理の原則にとどまらず、組織が実務で実行できる具体的なアクションに落とし込むことを目指して設計されています。そのため、企業のDX担当者やリーダーが社内ルールを整備する際のAIリスク教本として非常に有用です。

また、既存のサイバーセキュリティフレームワーク(CSF)と連携しやすい構造になっているため、すでに情報セキュリティ体制を構築している企業は、ゼロから新しい管理体制を作るのではなく既存の延長線上でAIリスクに対応できます。企業全体でのリスクアセスメント手順について知りたい場合は、【2026年版】企業向けAIリスクマネジメント実践ガイドや【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順もあわせて参照してください。

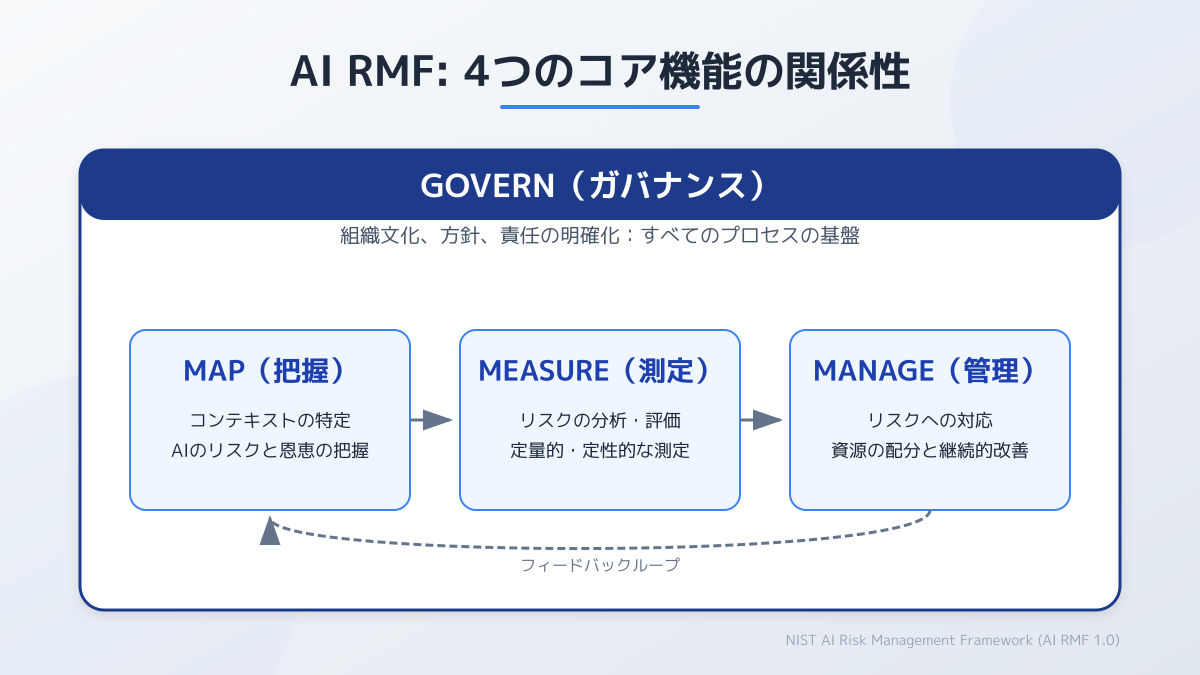

AIリスクを管理する4つのコア機能

AIリスクマネジメントフレームワークは、AIのライフサイクル全体をカバーするために4つのコア機能で構成されています。これらは単発のチェックリストではなく、継続的かつ相互に連携しながら機能するサイクルです。

1. GOVERN(統治)

4つの機能の中で最も重要視され、すべての土台となるのが「GOVERN」です。組織全体のリスク管理文化の醸成、ポリシーの策定、責任の所在の明確化を担います。経営層による強固なガバナンス体制が構築されていなければ、現場でのリスク特定や管理を組織的に実行することはできません。体制構築を担う専門人材の育成については、【2026年版】AIガバナンス協会とは?専門家になるための資格・求人動向・必須スキルが参考になります。

2. MAP(特定)

AIシステムが使用されるコンテキスト(文脈)を理解し、関連するリスクを特定・分類する機能です。業務効率化などの想定されるメリットだけでなく、情報漏洩やハルシネーション(もっともらしい嘘)といった意図しない悪影響も洗い出します。

3. MEASURE(測定)

特定されたリスクを、定量的・定性的な手法を用いて分析・評価します。例えば、出力結果にバイアスが含まれていないか、堅牢性が保たれているかなどを信頼できる指標に基づいてテストします。

4. MANAGE(管理)

測定されたリスクを組織の許容可能なレベルまで低減するための対策を実行し、監視します。AIの判定結果を最終決定とせず、必ず人間の担当者がレビューするフロー(ヒューマン・イン・ザ・ループ)を設計することなどが含まれます。

企業が実践すべきAIリスク管理「5つの要点」

AIリスク教本としてNIST AI RMFを現場で運用するにあたり、担当者が押さえておくべき5つの要点を解説します。

要点1. 組織全体でのガバナンス体制の構築

リスク管理の出発点は、前述の「GOVERN」によるガバナンス体制の構築です。誰がAIシステムの導入を承認し、誰が運用結果の責任を持つのかを明確に定義します。シャドーAI(従業員による無断利用)を防ぐためのルール周知もこのフェーズで行います。

要点2. 抽象的なAI倫理を実務プロセスへ落とし込む

「公平性」や「透明性」といった抽象的な原則を、開発や運用現場の具体的なアクションへと変換します。例えば「LLMを活用して社内文書を要約する際、入力データに個人情報を含めないシステム制御を行う」といった明確な判断基準を設けます。

要点3. 特定の技術に依存しない汎用的なルールの適用

特定のツールや業界に縛られない汎用的なアプローチをとることで、今後新たなAI技術が登場した際にも柔軟に対応できます。自社のビジネスコンテキストに合わせて評価項目をカスタマイズすることが重要です。

要点4. 国際標準との整合性と生成AIへの対応

AI技術の進化は速いため、一度策定したルールを静的なマニュアルとして放置してはいけません。NISTは2024年に生成AIに特化したプロファイルを公開しており、こうした最新の国際基準を常に取り込んで継続的に改善を図る必要があります。

要点5. 既存のサイバーセキュリティ対策との統合

AIリスク管理を独立したプロジェクトとするのではなく、既存のサイバーセキュリティ体制と統合して運用します。これにより、従業員の負担を減らしつつ、包括的なセキュリティ網を構築できます。

【サンプル】人事採用システムにおけるAIリスク評価事例

NIST AIリスク管理フレームワークを自社に適用するイメージを掴むため、人事採用システムにAIを導入する際のリスク評価サンプルを紹介します。実務ではこのようなシートを用いて各機能を実行します。

- GOVERN(統治)の定義

- 責任者: 人事部長および情報セキュリティ責任者

- ポリシー: AIの選考結果だけで不採用を決定せず、必ず人間の担当者が最終確認を行う

- MAP(特定)の項目

- 特定したリスク: 過去の採用データに基づく学習により、特定の性別や年齢層に対して不利な評価(バイアス)を下すリスク

- 影響範囲: 企業のブランドイメージ低下、法的な差別問題への発展

- MEASURE(測定)の指標

- 評価方法: 過去のテストデータを用いて、性別・年齢別の書類通過率を測定

- 許容基準: 属性間での通過率の差異が5%以内であること

- MANAGE(管理)の対策

- 実行策: 差異が基準を超えた場合、モデルの再学習を実施する。運用開始後も毎月1回、合格者の属性バランスをモニタリングしレポートを提出する

このように、AIリスクの4つのコア機能を具体的なタスクに落とし込むことで、抽象的なリスクをコントロール可能なプロセスへと変換できます。

よくある質問

NIST AI RMFは中小企業でも導入できますか?

はい、導入可能です。NISTのフレームワークは汎用的に設計されているため、企業の規模に合わせて適用範囲を調整できます。まずは「GOVERN(統治)」にあたる社内の基本ルール(生成AIの利用ガイドラインなど)の策定から始めることをおすすめします。

シャドーAIを防ぐにはどうすればよいですか?

従業員が個人の判断で無許可のAIツールを利用する「シャドーAI」は、情報漏洩の大きな原因となります。これを防ぐには、会社が安全性を確認した公式のAIツールを導入し、業務での利用を許可することが最も効果的です。詳しくは【2026年版】AIアシスタントとは?法人利用の危険性と安全なAIエージェント開発の3ステップをご覧ください。

まとめ

本記事では、企業がAIを安全に活用するための実践的なAIリスク教本として、NIST AIリスク管理フレームワークの主要な4つのコア機能と5つの要点を解説しました。

リスク管理のサイクルは「GOVERN(統治)」を土台とし、「MAP(特定)」「MEASURE(測定)」「MANAGE(管理)」を継続的に回すことで機能します。抽象的なAI倫理の原則を、人事評価やシステム開発などの現場実務へと落とし込み、既存のセキュリティ対策と統合していくことが重要です。

変化の激しいAI時代において、自社のガバナンス体制を継続的にアップデートし、安全かつ効果的な業務効率化を実現していきましょう。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

【2026年版】企業向けAIリスクマネジメント実践ガイド|自社を守るリスクアセスメントと管理手順

企業のAI活用に伴うリスクを可視化して対策する「AIリスクマネジメント」の全体像。自社で利用するAIツールに潜む危険性を評価するリスクアセスメントの具体的なステップと、継続的な管理体制の構築方法を解説します。

【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順

生成AI導入による情報漏洩やシャドーAIのリスクをどう防ぐべきか?社内のルール策定にお悩みのDX・IT担当者へ向け、経済産業省のAIガバナンスガイドラインの要点や、安全なプラットフォームを活用した6つの構築手順を具体的に解説します。AIガバナンスとは何かという基礎から、明日から使えるガイドラインのサンプル、現場の運用体制まで網羅した完全ガイド。

【2026年版】AIガバナンス協会とは?専門家になるための資格・求人動向・必須スキル

企業のAI活用に伴うリスクを管理する「AIガバナンス」専門人材の需要が急増しています。本記事では、AIガバナンス協会が提唱する専門家への道筋や、実務で役立つ資格、最新の求人動向を具体的に解説。DX推進担当者がAIを安全に運用するための必携ガイドです。

AIキャラクターとは?Claude Mythosの進化と安全な業務活用ガイド

高度なAIキャラクターやエージェントの普及が進む中、Anthropicの「Claude Mythos」が突きつけるAIの欺瞞行動と倫理的課題を解説。人間を超える能力を持つAIとどう向き合い、ガバナンスを構築すべきか、パンドラの箱の正体に迫ります。

2026年版:AnthropicのClaude Mythosとは?ビジネス活用と最新モデルの選び方

Anthropicが開発するClaudeの最新モデル情報を網羅。Opus 4.7やClaude Codeの進化を解説するとともに、最上位モデル「Claude Mythos」がProject Glasswingで限定提供され、一般公開されないセキュリティ上の理由に迫ります。

AnthropicのClaude Mythosとは?未公開AIの全貌と一般公開されない理由

2026年4月にAnthropicが発表した未公開の最上位AI「Claude Mythos(クロード ミュトス)」。その驚異的なサイバーセキュリティ能力と、なぜ「神話」という名が冠されたのか、語源や読み方からAIの未来を考察します。