AIのハルシネーション対策ガイド|原因と誤出力を防ぐ5つのプロンプト事例

生成AIが事実と異なる嘘をつく「ハルシネーション」の原因と、出力を正確にコントロールする5つの実践的な対策プロンプトを紹介。リスクを抑えてAIを安全に業務活用するための必読ガイドです。

AIが事実と異なる嘘の情報を出力してしまう「ハルシネーション」。業務でAIを活用する際、この誤出力を防ぐことは、情報漏洩や信頼性の低下を回避するために不可欠です。

本記事では、AIがなぜ嘘をついてしまうのか、ハルシネーションの原因を紐解きます。さらに、出力を正確にコントロールし、リスクを最小限に抑えるための5つの実践的なハルシネーション対策プロンプトを具体的な事例とともに解説します。

AIのハルシネーションが起こる原因

生成AI(LLM:大規模言語モデル)のハルシネーションは、主に「AIが確率的に次の単語を予測している」という技術的な仕組みそのものが原因で発生します。AIはデータベースのように事実を検索しているわけではなく、学習した膨大なテキストパターンから「最も自然に続く言葉」を生成しています。

具体的な原因としては以下の3点が挙げられます。

- 学習データの不足・偏り: AIの学習データに最新情報や専門的すぎる知識が含まれていない場合、AIは手持ちの知識だけで無理に回答を組み立てようとして嘘をつきます。

- 文脈や前提条件の欠如: ユーザーからの質問が短すぎたり曖昧だったりすると、AIは独自の解釈で文脈を補完し、事実とは異なる方向へ話を広げてしまいます。

- 「わからない」と言えない特性: デフォルトの設定では、AIはユーザーの質問に対して何らかの回答を返そうとするため、知識がなくても推測でもっともらしい文章を生成してしまいます。

これらの原因に対処するためには、プロンプトを通じてAIの振る舞いを厳格に制御することが最も効果的なハルシネーション対策となります。次章から、具体的な5つのプロンプト事例を見ていきましょう。

対策1:役割と前提条件を明確にするプロンプト

AIの誤出力を防ぐ第一歩は、「誰として、どのような前提で答えるべきか」をプロンプトで明確に定義することです。役割(ロール)を与えることで、AIの思考範囲が限定され、関係のない情報の混入を防ぐことができます。

このような役割定義は、プロンプトエンジニアリングの基礎としても非常に重要です。

プロンプト事例

# 指示

あなたは経験豊富な「ITコンサルタント」です。

以下の【前提条件】を厳守し、非エンジニアにもわかりやすい言葉で回答してください。

# 前提条件

・日本のビジネス環境に即した内容にすること

・法的な断言は避け、あくまで一般的なITツールの導入事例として回答すること

・専門用語には必ず簡単な注釈をつけること

# 質問

中堅企業が初めてチャットツールを導入する際の注意点を3つ教えてください。

このように前提条件を箇条書きで具体的に指定することで、AIが的外れな回答や推測に走るリスクを抑えられます。

対策2:事実データを提供して根拠を限定するプロンプト

ハルシネーション対策として非常に効果的なのが、プロンプト内に一次情報(社内規定や議事録など)を直接入力し、「この情報の中だけで回答してください」と根拠を限定する方法です。

プロンプト事例

# 指示

以下の【参考資料】の内容のみに基づいて、ユーザーの質問に回答してください。

回答の末尾には、必ず参考にした資料のセクション名を見出しとして記載してください。

# 参考資料

(ここにマニュアルや規定のテキストを貼り付ける)

# 質問

経費精算の申請期限はいつまでですか?

AIに外部の不確かな知識を使わせず、提供したコンテキストのみに依存させることで、事実誤認を大幅に減らすことが可能です。

対策3:推測を禁止し「不明」と答えさせるプロンプト

AIはわからないことでも無理に答えようとします。単に「嘘をつかないで」と指示してもAIには伝わりづらいため、情報がない場合の具体的な出力ルールを定めることが重要です(参考:「ハルシネーションしないで」が逆効果になる理由と対策)。

プロンプト事例

# 指示

以下の【議事録】を要約してください。

# ルール

1. 【議事録】に明確に記載されている事実のみを出力すること。

2. 記載がない事柄や、文脈から確証が得られない場合は、絶対に推測で補わず「情報がありません」と出力すること。

3. あなたの事前知識は一切使用しないこと。

# 議事録

(ここに議事録のテキストを貼り付ける)

推測を明確に禁止するルールを設けることで、AIの知識の境界線を認識させ、不確実な領域に踏み込むことを防ぎます。

対策4:思考プロセスを出力させるプロンプト

複雑な質問に対しては、AIにいきなり最終的な答えを出させるのではなく、「どのように考えてその結論に至ったのか」という推論の過程をステップごとに出力させる手法(Chain of Thought)が有効です。

プロンプト事例

# 指示

以下の【顧客の状況】に対する最適なアプローチを提案してください。

回答は、以下の【思考プロセス】のステップに沿って段階的に出力してください。

# 思考プロセス

ステップ1: 顧客の現状の課題を箇条書きで整理する

ステップ2: その課題に対して考えられる解決策を3つ挙げる

ステップ3: 各解決策のメリットとデメリットを比較する

ステップ4: 上記の比較をもとに、最も推奨するアプローチを結論として提示する

# 顧客の状況

(ここに顧客情報を記載)

AIに論理的なステップを踏ませることで、推論の精度が上がり、ハルシネーションの発生を抑制できます。また、人間がチェックする際にも、どこでAIが誤認したのかを発見しやすくなります。

対策5:事実確認を容易にする出典明記プロンプト

出力された結果のファクトチェックを効率化するため、回答の元となった該当箇所(引用元)をそのまま出力させるプロンプトです。

プロンプト事例

# 指示

以下の【長文レポート】から、AI規制に関する重要なトレンドを3つ抽出してください。

# 出力形式

抽出したトレンドごとに、必ずレポート内の該当箇所をそのまま引用符("")で囲んで併記してください。

出力例:

1. トレンドの要約

引用:「〜〜〜〜(該当部分の原文そのまま)」

# 長文レポート

(ここにレポートのテキストを貼り付ける)

要約と同時に原文を引用させることで、AIが文脈を曲解したり、都合の良い部分だけを切り取ったりしていないかを、人間が瞬時に見比べることができます。

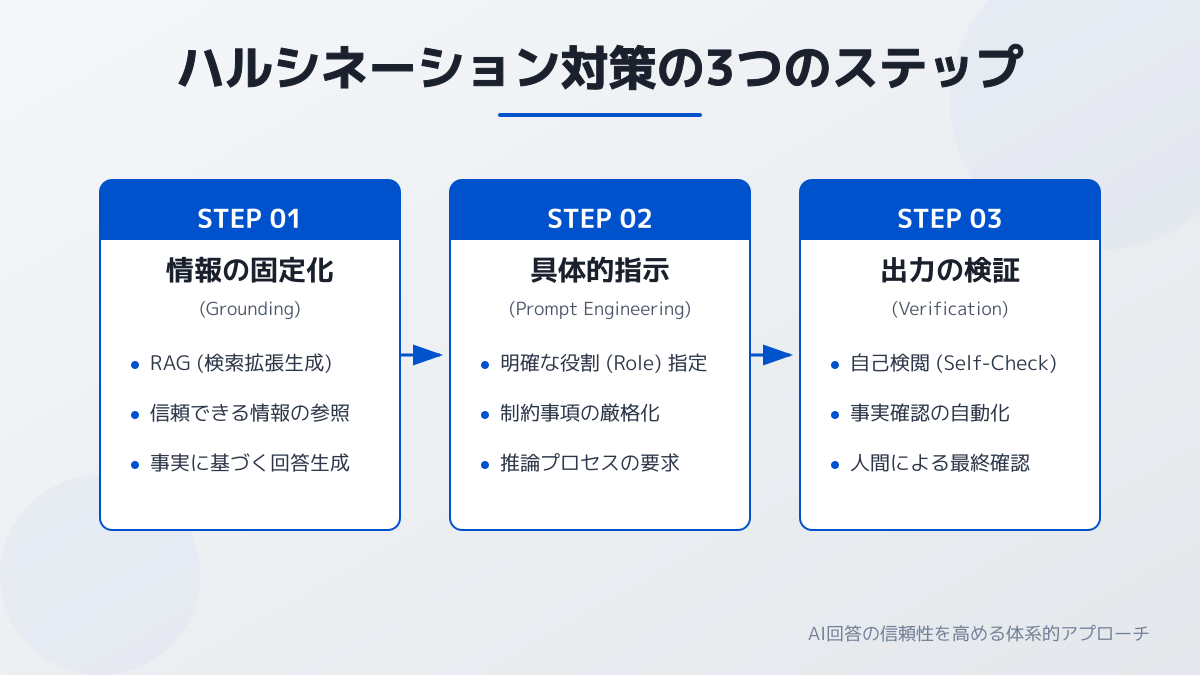

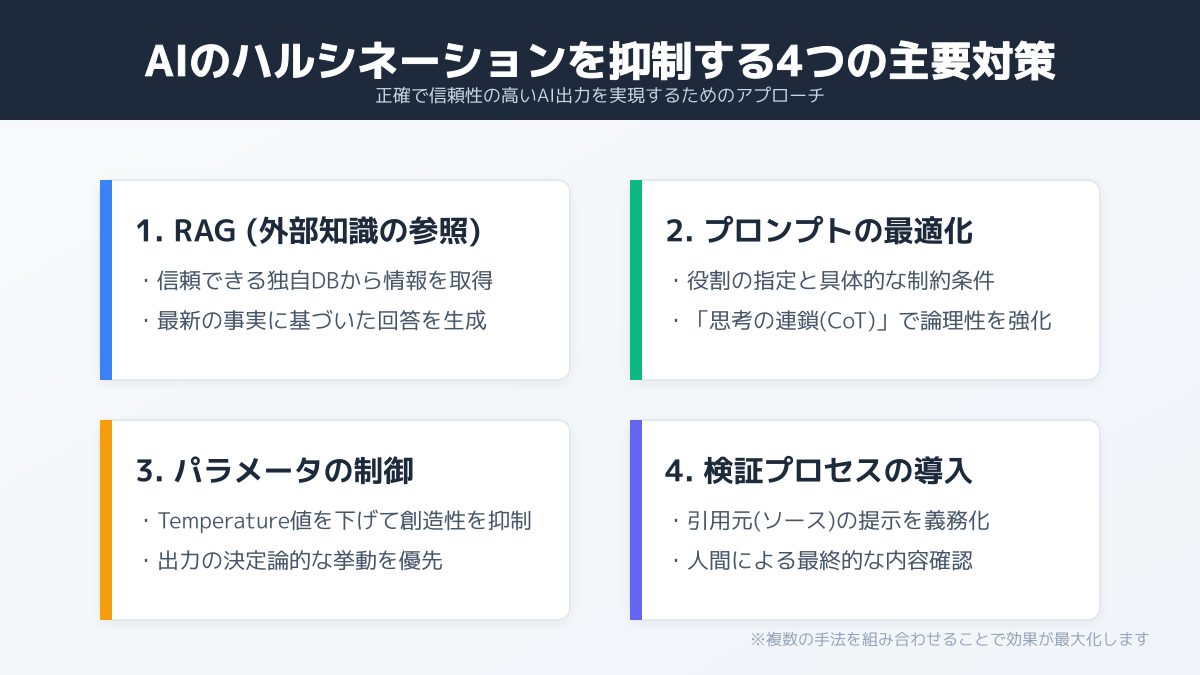

RAGの活用と組織的なファクトチェック体制

プロンプトの工夫だけで全ての誤出力を防ぐことは難しいため、システム的なアプローチと組織のルール整備を組み合わせることが重要です。

社内データと連携する「RAG」の導入

AI自身の記憶に依存させず、常に最新の社内ドキュメントを検索してから回答を生成させる技術が「RAG(検索拡張生成)」です。生成AIを用いた社内データ活用の導入ステップを参考にRAG環境を構築することで、大規模な資料に対するハルシネーションリスクを劇的に低減できます。

組織的な運用ルールとガバナンス

現場で安全にAIを活用するには、「AIの出力は最終的に人間が責任を持って確認する(Human-in-the-Loop)」という基本ルールを徹底する必要があります。

- 出典の確認義務: AIが生成した情報を外部に発信する際は、必ず一次情報にあたって事実確認を行う。

- 用途の制限: 法的判断や重要な契約書の作成など、ハルシネーションが致命的なリスクになる業務では、AIの利用をアイデア出し程度に留める。

組織全体のルール作りに迷う場合は、企業向けのAIガバナンスガイドラインや、生成AIの情報漏洩リスクを防ぐ導入ガイドラインも参考に、自社に合った管理体制を構築してください。

まとめ

AIのハルシネーションを防ぐためには、AIの仕組みと原因を理解し、的確な指示を出すことが不可欠です。本記事で紹介した5つの対策プロンプトは、明日からすぐに実務で活用できるものばかりです。

- 役割と前提条件を明確にする

- 事実データを提供して根拠を限定する

- 推測を禁止し「不明」と答えさせる

- 思考プロセスを出力させる

- 出典を明記させ事実確認を容易にする

これらのプロンプト技術に加えて、RAGなどのシステム連携や人間によるファクトチェックのフローを組み合わせることで、リスクを抑えながらAIの恩恵を最大限に引き出すことができます。安全なAI活用に向けた第一歩として、ぜひ社内のガイドラインや定型プロンプトに取り入れてみてください。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

AIに「ハルシネーションしないでください」は逆効果!嘘を防ぐプロンプトと8つの対策

AIに「ハルシネーションしないでください」と指示すると、かえって嘘をつく確率が高まることをご存知ですか?本記事では、ChatGPTなどがハルシネーションを起こす理由を解説し、事実に基づく回答を得るための具体的なプロンプト例や、RAGによる外部連携など8つの実践的な対策を徹底解説します。

【2026年版】生成AI活用のおすすめ本・書籍と仕事で役立つ資格3選

生成AIのビジネス活用スキルを体系的に学びたい方向けに、2026年最新の役立つ資格試験とおすすめの書籍を厳選して紹介します。自社のDX推進担当者のスキルアップや、社内研修の教材選びに迷っている方は必見です。

【2026年版】生成AI活用アイデア7選!意外な事例で自社業務を劇的に変える方法

文章要約や翻訳だけで終わっていませんか?日常生活や他業界の意外なAI活用事例からヒントを得て、自社業務を劇的に変える「生成AI活用アイデア」7選を解説します。組織の生産性を高める実践的なビジネス発想術をお届けします。

【2026年版】業務効率化とは?反発を防ぐビジネスの「言い換え」とAI導入の組織マネジメント7つのコツ

「業務効率化とは」単なる時間短縮ではなく、浮いた時間を価値創造に再投資することです。本記事では、現場の反発を防ぐビジネスでのポジティブな「言い換え」例文集と、AIツールを組織全体に定着させる7つのマネジメント術を解説します。

【2026年版】営業の業務効率化につながる生成AI活用事例7選!導入のポイントも解説

営業部門における業務効率化の成功事例を厳選して紹介。顧客リサーチの短縮からパーソナライズされた提案書の作成、日報の自動化まで、ビジネス現場ですぐに実践できる具体的な生成AIの活用事例を解説します。

【2026年版】RPA×生成AIの活用方法|業務効率化ツールで自動化の限界を突破する6つのポイント

定型作業はRPA、非定型作業は生成AIに任せることで、これまでの自動化の限界を突破できます。本記事では、RPAと生成AIを組み合わせた具体的な活用方法と、業務効率化ツールの効果を最大化する6つの導入ステップを解説。組織の生産性を劇的に高める実践的なノウハウが分かります。