【2026年版】生成AIのリスクとは?情報漏洩を防ぐ5つの対策と安全な導入ガイドライン

従業員による生成AIの不用意な利用が招く情報漏洩リスクの実態。機密情報や個人情報の流出を防ぐためのオプトアウト設定、社内ルールの周知徹底、そしてセキュアなAI環境の構築など、企業が直ちに行うべき必須対策を詳解します。

タイトル: 生成AIのリスクとは?情報漏洩やハルシネーションの対策を徹底解説 メタディスクリプション: 生成AIの導入で懸念される情報漏洩やハルシネーションなどのリスクと、その具体的な対策を解説します。安全なAI活用を実現するためのガイドライン策定やシステム制御の手順がわかり、社内導入をスムーズに進められます。

生成AIの導入は業務効率化の要です。しかし、情報漏洩や著作権侵害といった生成AIのリスクを懸念し、活用に踏み切れない企業は少なくありません。

適切なガイドラインとシステム制御を導入すれば、これらのリスクを最小限に抑え、安全にAIを活用できます。本記事では、生成AIに潜む5つの主要なリスクと、企業が今すぐ講じるべき具体的な対策手順を解説します。

社内での安全な運用イメージを掴むには、教員の働き方が面白いほど変わる!教育現場の生成AI活用事例と導入ガイド もあわせて参考にしてください。

生成AI利用における主なリスク

企業が業務効率化に向けて生成AIを導入する際、利便性の裏に潜むセキュリティ課題を正しく把握することが不可欠です。本セクションでは、 生成AIのリスク の全体像を整理します。

生成AIをビジネスで安全に活用するためには、脅威の種類を体系的に理解する必要があります。NRIセキュアの解説によると、生成AIのリスクは主に「機密情報の漏洩」「生成物の不正確性(ハルシネーション)」「サイバー攻撃への悪用」などに分類されます。

これらのリスクは、システムの脆弱性だけでなく、従業員の意図しない操作によっても引き起こされます。安全なAI活用には、適切な指示文の作成スキルも求められます。具体的な入力手法については、【2026年版】プロンプトとは?意味がわかるプロンプトエンジニアリング入門|AIエージェントの作り方とLLM活用事例 を参考にしてください。

AI利用で起こる情報漏洩の原因

生成AIの業務活用が急速に進む一方で、企業が直面する大きな課題が情報漏洩です。従業員が意図せず機密データを入力してしまうことで、重大なセキュリティインシデントに発展する可能性があります。

生成AIは、議事録の要約や企画書の作成など、さまざまな用途で活用されています。しかし、社外秘のプロジェクトデータや顧客情報をそのままプロンプトに入力してしまうケースが少なくありません。

利用しているAIツールが入力データを学習に利用する仕様の場合、自社の機密情報が他社への回答として出力される危険性があります。これが、企業にとって深刻な AI情報漏洩リスク および AIの個人情報リスク の本質です。

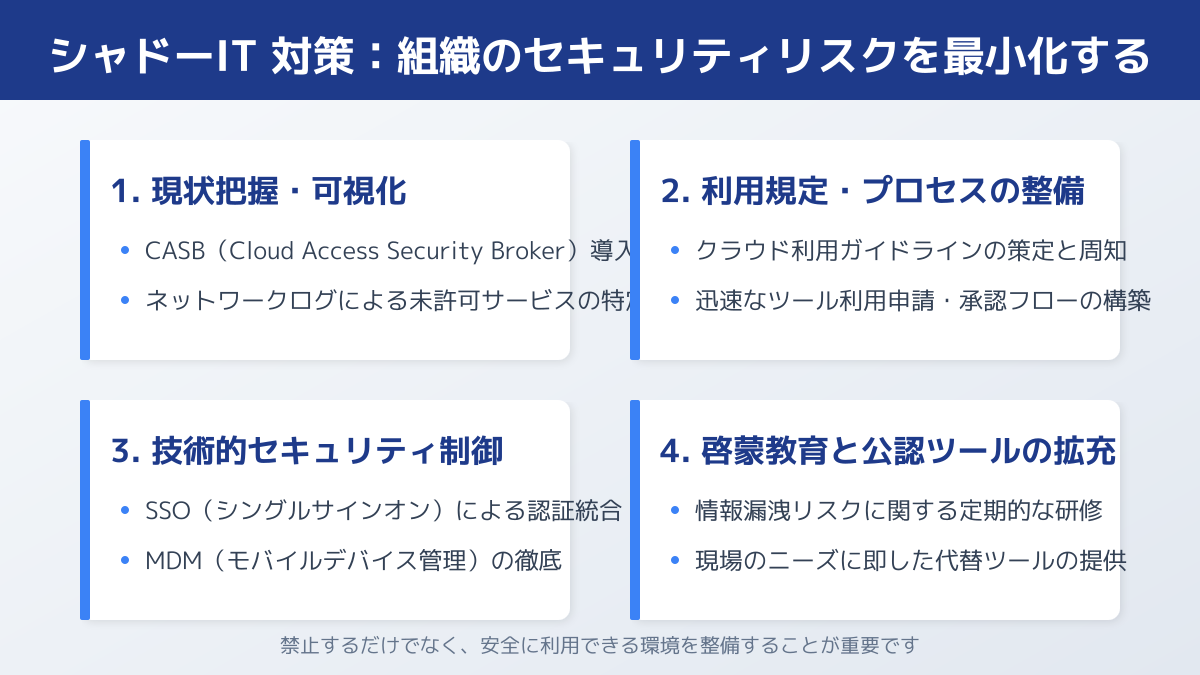

このリスクをさらに高めているのが、企業が許可していないAIツールを従業員が個人の判断で利用する「シャドーIT」です。管理部門の目が届かないところで機密情報が扱われる事態が頻発しています。こうした個人利用の危険性や法人向け対策の詳細は、【2026年版】AIアシスタントとは?法人利用の危険性と安全なAIエージェント開発の3ステップ を参考にしてください。

ハルシネーションの定義と発生原因

生成AI特有のリスクとして、事実とは異なる情報をあたかも真実であるかのように出力する「ハルシネーション(幻覚)」があります。この現象は、AIの技術的なメカニズムに起因しています。

大規模言語モデル(LLM)は、膨大な学習データから「次に来る確率が最も高い単語」を予測して文章を生成します。そのため、学習データに存在しない情報や、論理的な裏付けのない事象に対しても、もっともらしい嘘を出力してしまいます。

実際に、米国の弁護士がChatGPTを使って作成した準備書面に架空の判例が含まれており、裁判所から約5,000ドル(約75万円)の罰金を科された事例が報告されています。業務でAIの出力をそのまま利用すると、企業の信頼失墜や重大な損害につながる恐れがあります。

ハルシネーションを防ぐためには、AIの出力を鵜呑みにせず、必ず人間が事実確認(ファクトチェック)を行うプロセスを業務フローに組み込むことが不可欠です。あわせて、AIに役割や前提条件を明確に指定し、事実に基づく回答を引き出すプロンプト手法の習得も求められます。

著作権侵害と法的責任のリスク

生成AIが学習するデータには、インターネット上の著作物が大量に含まれています。そのため、AIが生成したコンテンツが既存の著作物と類似し、意図せず著作権侵害を引き起こすリスクがあります。

2023年には、米ニューヨーク・タイムズ紙が「自社の記事が無断でAIの学習に使用された」として、OpenAIとMicrosoftを提訴しました。このように、学習データの権利処理に関する法的な議論は現在も続いています。

企業がマーケティング資料やWebコンテンツの作成にAIを利用する場合、出力結果が他者の著作権を侵害していないかを確認する責任が生じます。類似性チェックツールの導入や、商用利用が明記された安全なAIモデルの選定が求められます。

倫理的課題とバイアスの問題

AIモデルは過去の人間が作成したデータから学習するため、データに含まれる偏見や差別的な表現(バイアス)をそのまま引き継ぐリスクがあります。これは企業の倫理的責任に直結する問題です。

過去には、大手IT企業が開発した採用AIが、過去の採用データにおける男性優位の傾向を学習し、女性の応募者を不当に低く評価してしまうという事例が発生しました。このプロジェクトは最終的に運用が中止されています。

人事評価や与信審査など、人間の人生や権利に重大な影響を与える領域でAIを活用する場合、出力結果にバイアスが含まれていないかを継続的に監視する体制が必要です。

サイバー攻撃への悪用リスク

生成AIの高度な文章作成能力やプログラミング能力は、悪意のある第三者によってサイバー攻撃に悪用されるリスクを孕んでいます。攻撃の巧妙化と自動化が急速に進んでいます。

例えば、ターゲットの言語や文化に合わせた極めて自然なフィッシングメールが大量に自動生成されるようになっています。また、専門知識を持たない攻撃者でも、AIに指示を出すだけで高度なマルウェアのコードを作成できる事例が確認されています。

企業は、従来のセキュリティ対策に加え、AIを用いた未知の脅威を検知するシステムの導入や、従業員に対する標的型攻撃メールの訓練を強化する必要があります。包括的なリスク管理の枠組みについては、【2026年版】企業向けAIリスクマネジメント実践ガイド|自社を守るリスクアセスメントと管理手順 を参考にしてください。

情報漏洩などの生成AIリスクを防ぐ5つの対策

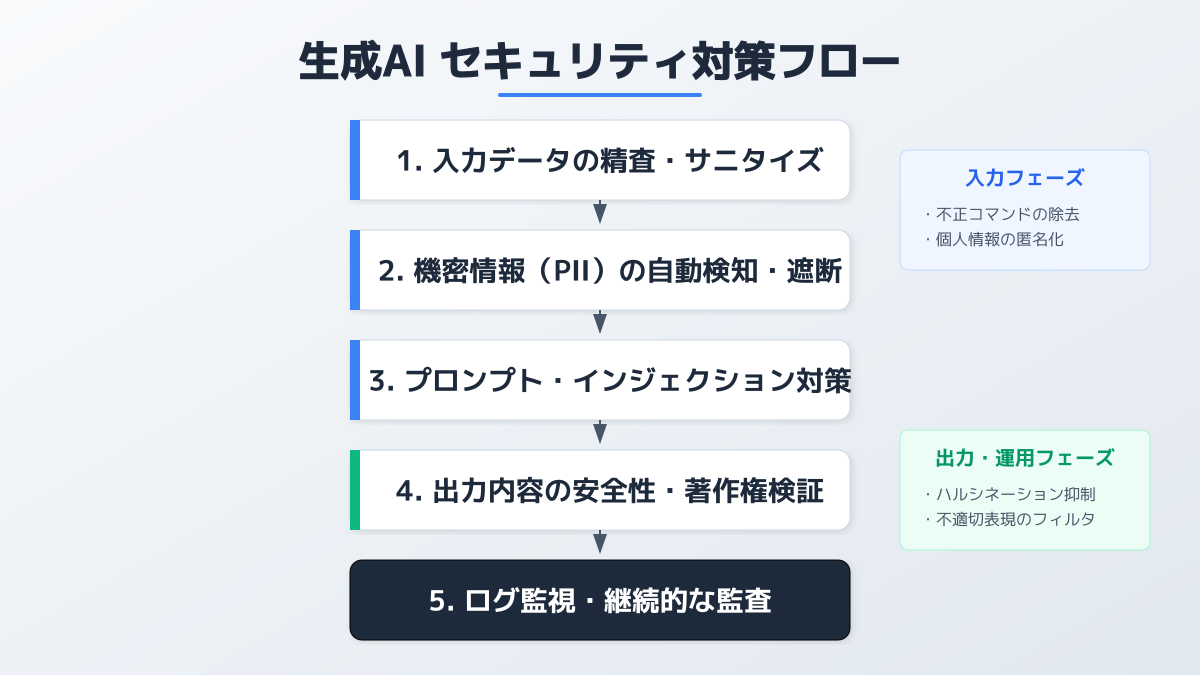

これまで解説した多様なリスクから企業を守るためには、組織的な 生成AIリスク対策 が求められます。情報漏洩やハルシネーションの被害を最小限に抑え、今すぐ実践すべき5つの具体的な対策は以下の通りです。

-

法人向けプランの導入とオプトアウトの徹底 入力データがAIの再学習に利用されない法人向けプラン(エンタープライズ版など)を契約するのが最も確実な対策です。もし無料版を業務で利用する場合は、必ずオプトアウト(学習拒否)設定を有効にし、入力内容がモデル学習に使われないよう制限します。

-

DLPツールやシャドーIT対策ソリューションの導入 技術的な制御として、DLP(データ損失防止)ツールやCASBを導入します。プロンプトに特定の機密キーワードや個人情報が含まれる通信を検知・ブロックし、従業員による未許可ツール(シャドーIT)の利用を監視します。

-

実務に即した利用ガイドラインの策定 「どの情報を入力してよいか」「どの業務で使ってよいか」を明確にした社内ルールを設けます。漠然とした禁止ではなく、実務に寄り添ったガイドラインを策定することが、安全な活用の第一歩です。国際標準の枠組みを活用したリスク管理については、企業向けAIリスク教本|NIST AIリスク管理フレームワークで学ぶ4つのコア機能と5つの要点 で詳しく解説しています。

-

出力結果のファクトチェック体制の構築 AIによるハルシネーションリスクを想定し、出力された内容をそのまま外部に公開しないフローを構築します。人間が必ず目視で事実確認(ヒューマン・イン・ザ・ループ)を行うステップを業務プロセスに組み込みます。

-

従業員への継続的なリテラシー教育 ガイドラインを策定して終わるのではなく、定期的な研修を実施します。最新の漏洩事例や、AIが引き起こすバイアス・著作権リスクの危険性を伝え、現場のITリテラシーを底上げします。

これらの対策をシステムと運用の両輪で進めることで、リスクを最小限に抑えた安全なAI活用が実現します。より具体的な導入事例や支援については、企業の生成AI導入を成功に導く3つの手順|導入支援の実例でわかる課題解決ガイド もあわせて参考にしてください。

安全な導入ガイドラインの策定ステップとサンプル

生成AIの導入を成功させるには、従業員が迷わず利用できる「社内ガイドライン」の存在が不可欠です。策定においては、禁止事項ばかりを並べるのではなく、 「安全に使うための条件」 を具体的に提示することが重要です。

ガイドラインは以下の3ステップで策定します:

- 利用目的と対象ツールの定義 :会社として公式に認めるAIツール(例:法人向け契約済みのAIエージェントやセキュアなチャットツール)を指定し、それ以外の無断利用を禁止します。

- 情報の取り扱いルールの明文化 :顧客の個人情報、社外秘のプロジェクトデータ、未公開の財務情報など、プロンプトへの入力を禁止するデータを具体的に列挙します。

- 出力物の利用責任の所在 :AIが生成した文章やコードの最終的な責任は「それを利用する従業員」にあることを明記し、著作権侵害の確認やファクトチェックを義務付けます。

【生成AI利用ガイドラインの記載サンプル】 社内でガイドラインを策定する際の雛形(サンプル)として活用してください。

第1条(目的) 本ガイドラインは、従業員が業務において生成AIを利用する際の遵守事項を定め、情報漏洩や著作権侵害等のリスクを防ぐとともに、業務効率化を推進することを目的とする。

第2条(利用可能なツール) 業務において利用できる生成AIツールは、会社が契約・承認した法人向けアカウントのみとする。個人アカウントでの業務利用(シャドーIT)は原則禁止する。

第3条(禁止される入力情報) 以下の情報をプロンプトとして入力してはならない。

- 個人情報(顧客、取引先、従業員に関する情報)

- 当社の機密情報(未公開の事業計画、財務データ、ソースコード等)

- 第三者と秘密保持契約(NDA)を結んでいる情報

第4条(出力結果の取り扱いと責任)

- 生成AIの出力結果にはハルシネーション(事実誤認)が含まれる可能性があるため、従業員は自らの責任において事実確認(ファクトチェック)を行わなければならない。

- 生成されたコンテンツを社外向け資料や商用利用に用いる場合、既存の著作物を侵害していないか十分な確認を行うこと。

このようなガイドラインを社内ポータルに掲示し、入社時や定期研修の際に読み合わせを行うことで、現場の意識を高めることができます。

まとめ

生成AIは、正しく活用すれば企業の生産性を飛躍的に向上させる強力なツールですが、情報漏洩やハルシネーションといった 生成AIのリスク を無視することはできません。本記事では、AI利用における多様なリスクと、企業が取るべき具体的な対策を解説しました。

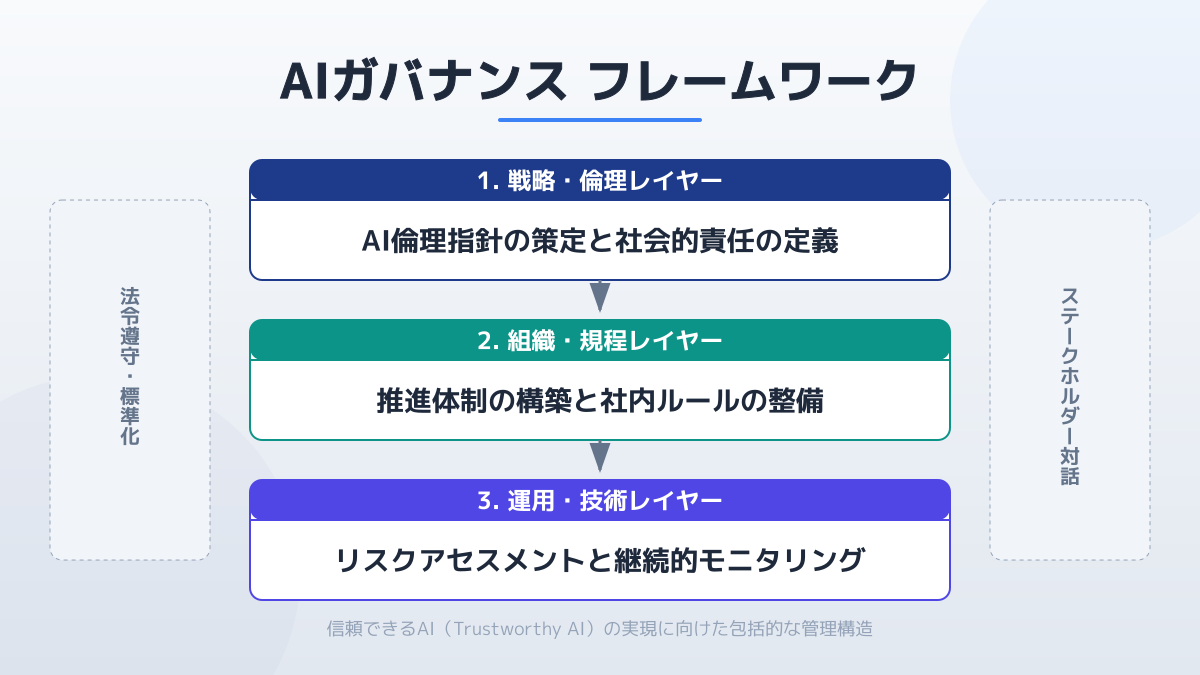

重要なのは、システム的なセキュリティ対策と、従業員への継続的な教育、そして実務に即した運用ガイドラインの策定を並行して進めることです。リスクを恐れて利用を制限するのではなく、適切なガバナンスを確立し、安全な環境下でAIを業務に組み込むことが、これからのDX推進において不可欠となります。ガバナンス体制の構築手順については、【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順 もあわせてご覧ください。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

【2026年版】企業向けAIリスクマネジメント実践ガイド|自社を守るリスクアセスメントと管理手順

企業のAI活用に伴うリスクを可視化して対策する「AIリスクマネジメント」の全体像。自社で利用するAIツールに潜む危険性を評価するリスクアセスメントの具体的なステップと、継続的な管理体制の構築方法を解説します。

【2026年版】AIガバナンス協会とは?専門家になるための資格・求人動向・必須スキル

企業のAI活用に伴うリスクを管理する「AIガバナンス」専門人材の需要が急増しています。本記事では、AIガバナンス協会が提唱する専門家への道筋や、実務で役立つ資格、最新の求人動向を具体的に解説。DX推進担当者がAIを安全に運用するための必携ガイドです。

企業向けAIリスク教本|NIST AIリスク管理フレームワークを実践する4つの機能と5つの要点

AI導入のリスク管理でお悩みの担当者向けに、実践的な「AIリスク教本」として国際標準のNIST AIリスク管理フレームワークを分かりやすく解説します。AIリスクの4つのコア機能や5つの要点など、企業が安全にAIを活用するためのノウハウを網羅した入門記事です。

2026年版:AnthropicのClaude Mythosとは?ビジネス活用と最新モデルの選び方

Anthropicが開発するClaudeの最新モデル情報を網羅。Opus 4.7やClaude Codeの進化を解説するとともに、最上位モデル「Claude Mythos」がProject Glasswingで限定提供され、一般公開されないセキュリティ上の理由に迫ります。

企業向け生成AI導入支援は必要?内製化かコンサルかで迷う3つの判断基準

生成AIの導入を検討する企業が直面する「自社で進めるか、外部コンサルタントに頼るか」という悩み。導入支援の費用対効果を明らかにし、内製化で進める場合のリソース配分や、失敗しないための判断基準を論理的に解説します。

【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順

生成AI導入による情報漏洩やシャドーAIのリスクをどう防ぐべきか?社内のルール策定にお悩みのDX・IT担当者へ向け、経済産業省のAIガバナンスガイドラインの要点や、安全なプラットフォームを活用した6つの構築手順を具体的に解説します。AIガバナンスとは何かという基礎から、明日から使えるガイドラインのサンプル、現場の運用体制まで網羅した完全ガイド。