EUのAIガバナンス規制とは?企業の事例から学ぶ安全な導入5つのポイント

世界で最も包括的とされるEUのAI規制(AI法)から学ぶ、グローバル基準のAIガバナンス体制の構築方法。国内企業の先進的な事例を交え、企業が押さえておくべき法規制トレンドと実践アプローチを解説します。

生成AIを現場へ導入したものの、シャドーAIによる情報漏洩や著作権侵害のリスクを恐れ、利用用途が限定的になっているDX担当者は少なくありません。安全かつ全社的な活用を進めるには、世界基準であるEUのAIガバナンス規則(AI Act)のリスク分類を自社に適用し、明確な運用ルールを敷くことが解決策となります。本記事では、国内企業のAIガバナンス事例を交えながら、リスク評価の手順や社内教育のポイントなど、安全な導入に向けた5つの実践ステップを具体的に解説します。

EUのAIガバナンスに学ぶリスク分類の基準

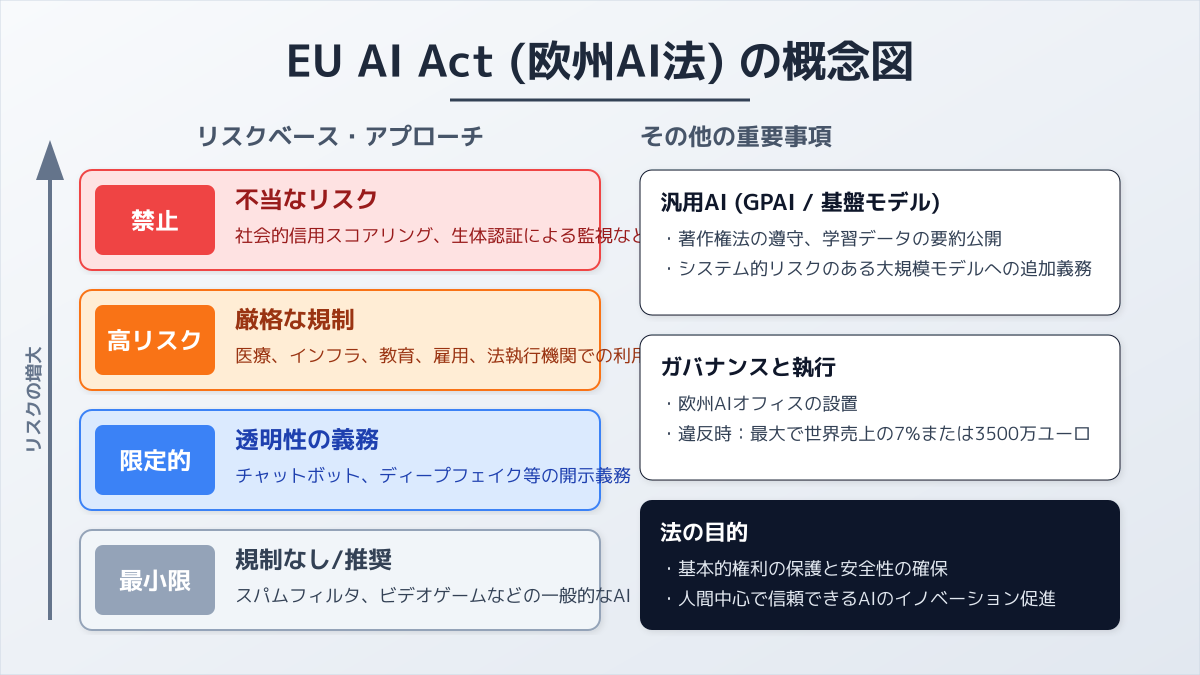

AIを安全に業務へ組み込むための第一歩は、システムがもたらすリスクを正確に分類し、それに応じた管理体制を敷くことです。特にEUのAIガバナンスの中核である「リスクベースアプローチ」は、グローバル展開を見据える企業にとって重要な基準となります。

EUのAI規制(AI Act)における最大の特徴は、AIシステムがもたらすリスクを「許容不能」「ハイリスク」「限定的」「最小限」の4段階に分類する点です。国内企業がAIガバナンス事例を構築する際も、このリスクベースの考え方を自社の業務要件に当てはめることが不可欠です。たとえば、国内の大手製造業では、このEUの基準と総務省が提唱するAIリスク4分類を組み合わせ、独自の社内アセスメントシートを運用しています。

具体的には、人事評価や採用活動における書類選考AIは個人の権利に影響を与えるため「ハイリスク」に分類し、厳格なデータ管理と人間の最終確認を義務付けています。一方、一般的な社内規程の検索ボットであれば「最小限」として迅速な導入を認めています。用途ごとにリスクを評価し、導入の可否や必要なセキュリティ要件を判断するプロセスを社内で明確化します。その際、導入にかかる費用や失敗しないための初期ステップも併せて検討するとスムーズです。

透明性の確保とシャドーAI対策

AIガバナンスを現場で運用する際の最大の注意点は、セキュリティ対策と業務効率化のバランスを保つことです。特に、従業員が未承認のAIツールを個人の判断で業務利用する「シャドーAI」を防ぐ必要があります。

安全な体制を確立している金融機関のAIガバナンス事例では、利用可能な生成AIツールをホワイトリスト化し、入力してよいデータと禁止データ(顧客の個人情報や未公開の財務情報など)を社内ガイドラインで明示しています。具体的なルールの作り方については、生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順も参考にしてください。

また、AIの出力結果をそのまま外部へ公開するのではなく、必ず人間が内容を確認して責任を持つ「ヒューマンインザループ(Human-in-the-Loop)」のプロセスを業務フローに組み込む必要があります。特に事実誤認(ハルシネーション)を防ぐためには、単に注意を促すだけでなく、システム的な制約やプロンプトの工夫などの具体的な対策を組み合わせることが重要です。生成AIを利用して作成した資料には、AIによる生成物であることを明示するルールを設けるなど、透明性の確保が求められます。

現場への定着とガイドライン運用

ルールを策定しても、現場の業務フローに定着しなければ意味がありません。すべての用途に対して一律の厳しい制限を設けると、生産性向上の妨げになります。

現場の担当者が迷わずに利用可否を判断できるよう、具体的なチェックリストを設けることが重要です。以下は、社内申請時に活用できるセルフチェックリストのサンプルです。

- 入力データの機密性: 顧客の個人情報や未公開の業績データを含んでいないか

- 出力の利用目的: 社内での参考情報か、社外向けの公式発表資料か

- 人間の介入: 最終的な意思決定や事実確認を人間が行うフローになっているか

- 著作権の侵害リスク: 他社の著作物や既存のコンテンツをそのまま出力させていないか

機密情報の入力を防ぐために、プロンプト入力時のデータマスキングツールを導入する企業も増えています。個人情報や未公開情報の流出は企業の信頼を大きく損なうため、情報漏洩を防ぐ具体的な対策と安全な導入環境の構築手順を事前に把握しておくことが不可欠です。

また、意図しない情報漏洩やプロンプトインジェクションといった脅威を防ぐためには、安全かつ効果的な指示の出し方を社内で標準化することが重要です。プロンプトエンジニアリング入門|AIエージェントの作り方とLLM活用事例などを参考に、基礎知識の底上げを図ることが推奨されます。

継続的なモニタリングと評価体制

AIの導入が進む中で、初期のルール策定だけでなく、運用開始後の継続的な監視体制が不可欠です。AIシステムは一度導入して終わりではなく、時間の経過とともに学習データや社会環境が変化するため、出力結果の妥当性やバイアスの有無を定期的に確認するプロセスが求められます。

リスク管理が機能している企業のAIガバナンス事例では、「誰が・いつ・どの指標を確認するか」という判断ポイントを明確に定義しています。リスクを可視化する具体的なステップについては、企業向けAIリスクマネジメントの実践ガイドや国際基準であるNIST AIリスク管理フレームワークの解説も併せて確認することをおすすめします。たとえば、月に1回、法務部門と現場リーダーが合同でAIの出力ログを監査し、EUのAIガバナンスをはじめとする最新の法的要件から逸脱していないかを定量的に評価する仕組みを設けています。

システム側の対策として、入力されたプロンプトのログを定期的に抽出し、機密情報が含まれていないかを自動または目視で監査する仕組みを導入する企業が増えています。ルール違反が発見された場合は、個人の罰則を目的とするのではなく、なぜその操作が行われたのかを分析し、ガイドラインの改訂やツールの改善につなげることが重要です。

AIガバナンスセミナーを活用した人材育成

AIガバナンスのルールを定めても、現場に浸透しなければ形骸化してしまいます。これを防ぐためには、定期的な監査と継続的な教育が欠かせません。

従業員のリテラシー向上のため、社内外の専門家を招いたAIガバナンスセミナーを定期的に開催し、最新のセキュリティ脅威や法規制の動向を共有する取り組みが効果的です。大手IT企業では、新入社員研修から経営層向けの勉強会まで、階層別にAIガバナンスセミナーを実施し、全社的なリスク認識の底上げに成功しています。AI技術は進化が早いため、一度ルールを作って終わりにするのではなく、外部のセミナーなどで得た最新の知見を取り入れ、技術動向や社会の要請に合わせてガバナンス体制を常にアップデートしていく姿勢が求められます。

具体的な現場への落とし込み方については、生成AIで社内データを活用する7つのステップや、教育現場の生成AI活用事例と導入ガイドも参考にしながら、自社の業務プロセスに合わせた体制を整備してください。

まとめ

AI技術の進化は目覚ましく、企業がその恩恵を享受するためには、堅牢なAIガバナンス体制の構築が不可欠です。本記事で紹介したAIガバナンス事例からわかるように、成功の鍵は以下の点に集約されます。

- EUのAI規制に代表される「リスクベースアプローチ」に基づき、AIシステムの用途に応じたリスク評価基準を明確にする

- 透明性の確保とシャドーAIの防止のため、利用ガイドラインの策定と従業員への徹底した教育を行う

- 導入後の継続的なモニタリングと評価体制を構築し、AIガバナンスセミナーなどを活用して技術や法規制の変化に合わせてガバナンスを常にアップデートする

これらの取り組みを通じて、企業はAIのリスクを最小限に抑えつつ、そのポテンシャルを最大限に引き出し、持続的な成長を実現できるでしょう。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

【2026年版】AIガバナンス協会とは?専門家になるための資格・求人動向・必須スキル

企業のAI活用に伴うリスクを管理する「AIガバナンス」専門人材の需要が急増しています。本記事では、AIガバナンス協会が提唱する専門家への道筋や、実務で役立つ資格、最新の求人動向を具体的に解説。DX推進担当者がAIを安全に運用するための必携ガイドです。

企業向けAIリスク教本|NIST AIリスク管理フレームワークを実践する4つの機能と5つの要点

AI導入のリスク管理でお悩みの担当者向けに、実践的な「AIリスク教本」として国際標準のNIST AIリスク管理フレームワークを分かりやすく解説します。AIリスクの4つのコア機能や5つの要点など、企業が安全にAIを活用するためのノウハウを網羅した入門記事です。

【2026年版】企業向けAIリスクマネジメント実践ガイド|自社を守るリスクアセスメントと管理手順

企業のAI活用に伴うリスクを可視化して対策する「AIリスクマネジメント」の全体像。自社で利用するAIツールに潜む危険性を評価するリスクアセスメントの具体的なステップと、継続的な管理体制の構築方法を解説します。

【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順

生成AI導入による情報漏洩やシャドーAIのリスクをどう防ぐべきか?社内のルール策定にお悩みのDX・IT担当者へ向け、経済産業省のAIガバナンスガイドラインの要点や、安全なプラットフォームを活用した6つの構築手順を具体的に解説します。AIガバナンスとは何かという基礎から、明日から使えるガイドラインのサンプル、現場の運用体制まで網羅した完全ガイド。

【2026年版】生成AIのリスクとは?情報漏洩を防ぐ5つの対策と安全な導入ガイドライン

従業員による生成AIの不用意な利用が招く情報漏洩リスクの実態。機密情報や個人情報の流出を防ぐためのオプトアウト設定、社内ルールの周知徹底、そしてセキュアなAI環境の構築など、企業が直ちに行うべき必須対策を詳解します。

【2026年版】RPA×生成AIの活用方法|業務効率化ツールで自動化の限界を突破する6つのポイント

定型作業はRPA、非定型作業は生成AIに任せることで、これまでの自動化の限界を突破できます。本記事では、RPAと生成AIを組み合わせた具体的な活用方法と、業務効率化ツールの効果を最大化する6つの導入ステップを解説。組織の生産性を劇的に高める実践的なノウハウが分かります。