【2026年版】AIハルシネーションとは?語源・英語の意味と企業が恐れる発生例・対策

AIのハルシネーションによる誤情報は、企業に致命的な損害を与えます。本記事では、ハルシネーションの語源や英語での意味から、なぜAIが嘘をつくのかを論理的に解説。架空の判例提出などの具体的な発生例から、ビジネス利用で欠かせない対策まで、2026年最新の視点で完全ガイドします。

AIのハルシネーションによるビジネスの失敗を防ぐ最大のポイントは、AIが「意図的な嘘」ではなく「確率的な幻覚」を生成する仕組みを理解し、人間によるファクトチェック体制を構築することです。本記事では、ハルシネーションの語源や英語での意味、実際の発生例から、誤情報を生み出すメカニズムと具体的な対策までを解説します。

ハルシネーションの語源

医学・心理学における本来の意味

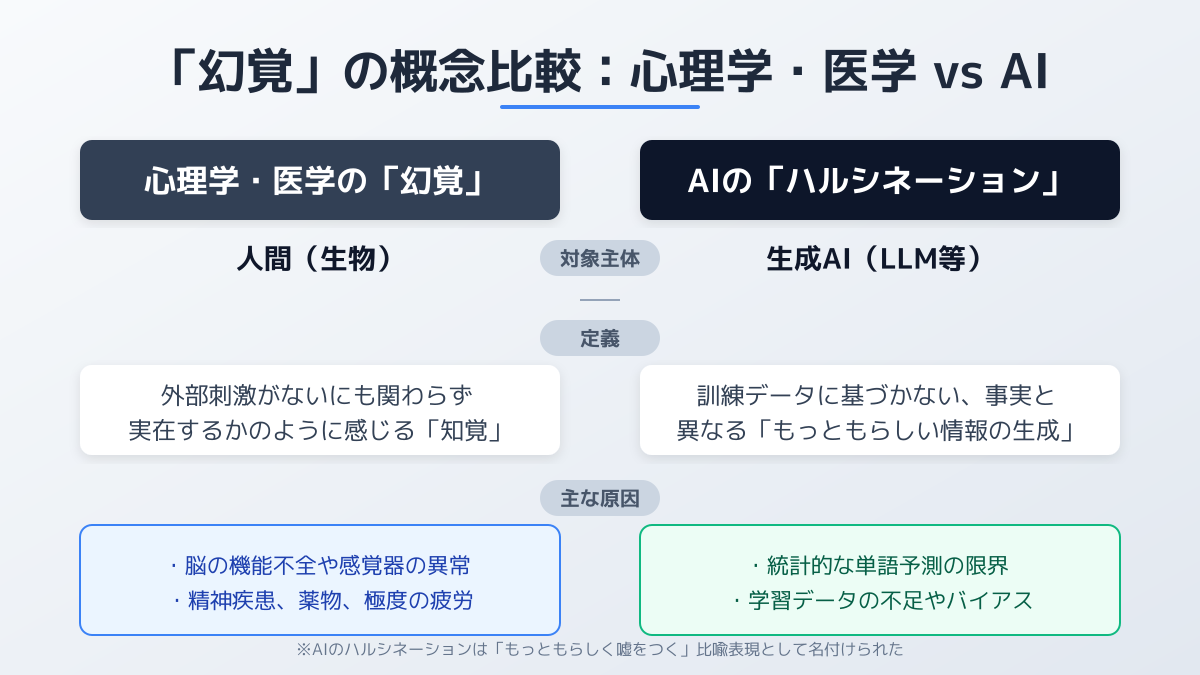

AI用語としてのハルシネーションの語源を理解するには、まず医学・心理学分野における本来の意味を知る必要があります。この言葉は、ラテン語の「alucinari(心の中をさまよう)」に由来します。医学的な「幻覚(Hallucination)」とは、実態がなく他人には認識できないものの、本人には確かに感じ取れる感覚のことです。

思考の異常である妄想とは異なり、知覚の異常を指すのが特徴です。特に統合失調症などで多く見られる症状であり、自分の悪口や指図する声が聞こえる「幻聴」などが代表的です(出典: 精神障害(精神疾患)の特性(代表例) - 厚生労働省)。

IT用語として定着した背景

この「本人は確信しているが、現実には存在しない」という状態が、AIの挙動と共通していることから、テクノロジーの分野でもこの言葉が使われるようになりました。AIは悪意を持って嘘をついているわけではなく、システムとして「幻覚」を生み出している状態と言えます。

こうしたAIの特性やリスクを正しく理解した上で、実務にどう組み込むかが重要です。実際の現場での具体的な活用イメージについては、教員の働き方が面白いほど変わる!教育現場の生成AI活用事例と導入ガイドも参考にしてください。

英語での意味とAIにおける定義

AIが事実と異なる回答を出力する現象を深く理解するためには、英語圏でのニュアンスと、AI技術における独自の定義を把握することが重要です。ここでは、ハルシネーションの英語での使われ方と、IT分野における意味を整理します。

英語圏における「Hallucination」のニュアンス

ハルシネーションの英語表記である「Hallucination」は、日常会話でも「あり得ないものを見ている」「錯覚している」といったニュアンスで使われます。単なる「Mistake(間違い)」や「Error(エラー)」とは異なり、「本人は真実だと思い込んでいるが、客観的には存在しない」という状態を強く指し示す英単語です。

AI分野における独自の「意味」

一方で、AIにおけるハルシネーションの意味は、人間の精神疾患や錯覚とは全く異なるアプローチで定義されます。AIモデルは「事実の正確性」よりも「文章の流暢さ」を優先して学習する構造的限界を持っています。そのため、学習データの不完全さやAIが文脈を正しく理解できていない状態が重なると、もっともらしく聞こえる誤情報を生成してしまいます(出典: AIコラム:生成AIにおけるハルシネーションとは? | 富士フイルムビジネスイノベーション - Fujifilm)。

また、ユーザーが入力するプロンプトが曖昧な場合も、誤出力を引き起こす大きな要因となります。これを防ぐための具体的な指示の出し方については、【2026年版】プロンプトとは?意味から学ぶプロンプトエンジニアリング入門|AIエージェントの作り方とLLM活用事例 を参考にしてください。

意味合いから読み解くビジネスリスク

この英語のニュアンスを紐解くと、AIは「意図的に嘘をついている」のではなく、確率的に自然な単語を繋ぎ合わせた結果として「幻覚を見ているような出力」をしているに過ぎないことが分かります。ビジネスの現場でAIを活用する際は、AIがどれほど流暢な文章を生成したとしても内容が正確とは限らないという前提に立ち、人間によるファクトチェックのフローを業務プロセスに必ず組み込むことが求められます。

誤情報を生成するメカニズムと種類

AIの文脈におけるハルシネーションの語源を深く探る上で、AIがなぜ「幻覚」に例えられるような誤答をするのか、その技術的なメカニズムの理解は欠かせません。ここでは発生原因と種類から、その本質を整理します。

AIが誤情報を生成する主な原因

AIのハルシネーションは、主に学習データの不完全さや、AIモデルの構造的な限界によって引き起こされます。AIモデルは「事実の正確性」よりも「文章の流暢さ」を優先して学習するため、もっともらしく聞こえる回答を生成するリスクがあります。

さらに、OpenAIの研究者らは、モデルの訓練方法や評価基準の設計そのものが誤答を促す構造になっていると指摘しています。多くのベンチマークテストでは、質問に対して「分からない」と回答するよりも、推測して答える方が高得点となる方式が採用されています。その結果、AIモデルは過剰に自信を持って誤った回答を返すように最適化されてしまうのです(出典: OpenAI、大規模言語モデルの「ハルシネーション(幻覚)」の原因を解説 評価方法の設計に問題と指摘 | Ledge.ai)。

ハルシネーションの2つの種類

ハルシネーションには、大きく分けて以下の2種類が存在します。

- 外在的ハルシネーション(Extrinsic Hallucinations): 学習データに全く存在しない内容を、あたかも事実のように出力する現象です。

- 内在的ハルシネーション(Intrinsic Hallucinations): 学習データに含まれる情報とは異なる、矛盾した内容を出力する現象です。

これらの分類を知ることは、出力された情報の真偽を見極め、AIの実際の挙動を照らし合わせて判断する上で役立ちます。

大規模言語モデル(LLM)における注意点

最新の大規模言語モデル(LLM)は、以前のモデルと比較してハルシネーションの抑制に強い特性を持っています。しかし、確率的に次の単語を予測する言語生成モデルの根本的な仕組みや、学習データの偏りが原因となるため、誤情報を完全に排除することは困難です。ニッチな専門領域や最新の時事問題については、AIが参照できるデータが少なく、事実と異なる内容を出力する確率が高まります。

ビジネスにおける深刻なリスクと発生例

生成AIを実務に導入する際、押さえておくべきなのが、誤情報がビジネスに及ぼす深刻なリスクと実際の失敗例です。

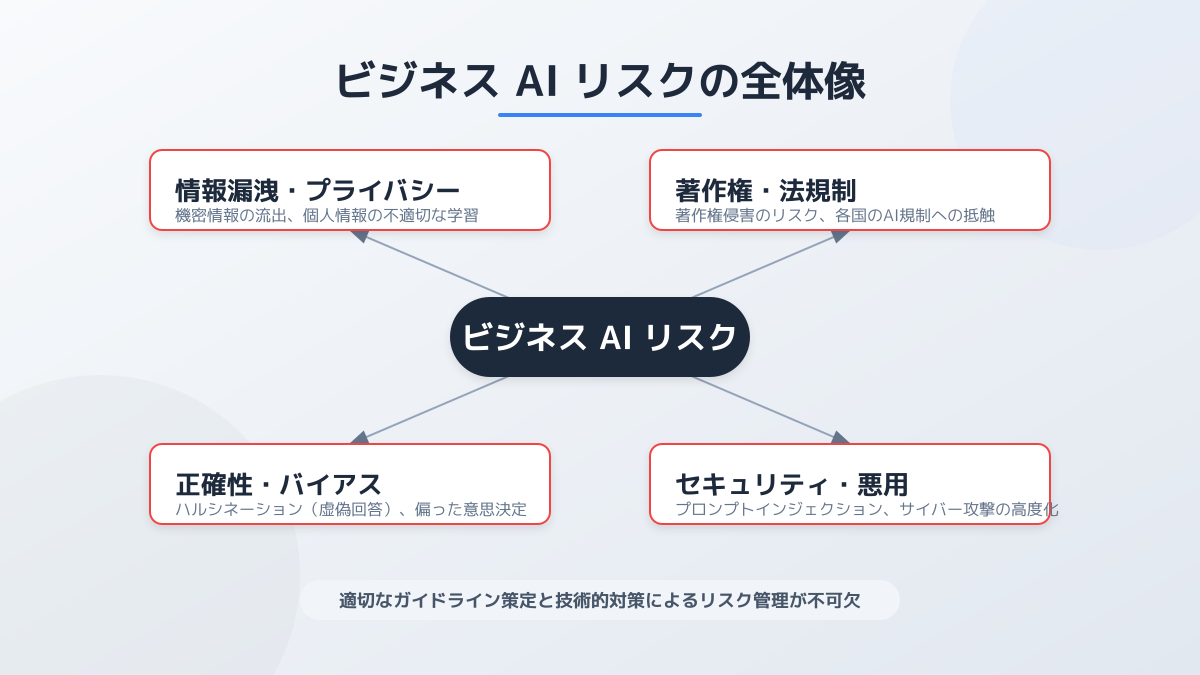

ビジネスプロセスにおける深刻なリスク

AIの出力を検証せずにそのまま公開・利用した場合、企業は重大な危機に直面します。ハルシネーションは、顧客からの信頼失墜、法的リスクの増大、ブランドイメージの毀損、そして経営陣の意思決定の誤りなど、ビジネスプロセス全体に深刻な影響を及ぼす可能性があります。

マサチューセッツ工科大学(MIT)のケーススタディでも、AIが自信を持って正しいように見えるが完全に間違った答えを生成することは、企業におけるAI活用の最大の問題と指摘されています。これは単なる不便で済む話ではなく、企業の信頼を破壊し、評判を根本から損なう致命的な失敗になり得ます(出典: How to Build an AI Chatbot That Never Hallucinates)。情報漏洩などの他のリスクも含めた総合的な対策については、【2026年版】生成AIのリスクとは?情報漏洩を防ぐ5つの対策と安全な導入ガイドラインをご覧ください。

実際に起きたハルシネーションの例

企業が特に恐れるべきハルシネーションの発生例として、過去に以下の事案が報告されています。

- 架空の判例を提出した弁護士の例 アメリカの弁護士が、ChatGPTが生成した架空の判例を法廷に提出してしまい、重い処分を受けたケースです。AIは実在しない事件名や判決文を、あたかも本物の法的文書のように極めて流暢に生成していました。

- 顧客に誤ったポリシーを案内した航空会社の例 海外の航空会社の公式チャットボットが、顧客に対して誤った返金ポリシーを案内し、企業側がその補償を余儀なくされた例もあります。

これらは、AIの回答が「流暢であること」と「事実であること」を人間が混同した結果起きた悲劇です。

リスクを回避するための要点

これらの例から学べるのは、AIはあくまで文章作成の優秀なアシスタントであり、事実確認の最終責任は人間が負うという運用ルールを社内で徹底することの重要性です。安全な活用のためには、出力結果を疑う姿勢が欠かせません。

現場の運用における判断ポイント

ビジネスにおいて、AIがもっともらしい嘘を出力する性質は極めて重大なリスクをもたらします。ここでは、現場でAIを安全に活用するための具体的な運用ルールを解説します。

情報源のトレーサビリティの確保

現場でAIを活用する際、その出力が事実か幻覚かを判断する最大のポイントは、情報源のトレーサビリティ(追跡可能性)にあります。AIが提示したデータや根拠が、社内の公式ドキュメントや信頼できる一次情報に実在するかを必ず確認する必要があります。

AIの文章は非常に流暢であるため、もっともらしい文脈で語られているほど、人間は無意識に信じ込んでしまう危険性があります。そのため、「AIが言っているから正しい」という前提を捨て、必ず元のデータソースに立ち返る習慣をつけることが重要です。

人間による確認プロセスの組み込み

こうしたリスクを防ぐため、現場での運用においては「AIの出力をそのまま公開・利用しない」という原則を徹底しなければなりません。さらに、従業員がAIを安全に利用できるよう、あらかじめ社内ルールを明確にしておくことが推奨されます。ガイドラインの作成手順については、【2026年版】生成AI利用ガイドラインの作り方|企業向けサンプルひな形と7つの対策 を参照してください。

特に顧客対応のチャットボット、外部向けのマーケティングコンテンツ制作、あるいは重要な会議の資料作成においては、必ず人間が最終確認を行うプロセスを業務フローに組み込むことが不可欠です。AIの利便性を最大限に引き出すためには、出力結果を盲信せず、常にファクトチェックを行う強固なガバナンス体制を構築することが、安全で確実なAI活用の第一歩となります。具体的なガバナンス体制の構築やリスク管理については、【2026年版】総務省の生成AIガイドライン解説|AIリスク4分類と社内ルールのサンプルや企業向けAIリスク教本|NIST AIリスク管理フレームワークを実践する4つの機能と5つの要点も併せてご参照ください。

ハルシネーションの発生条件と具体的な対策

AIが事実とは異なるもっともらしい嘘を出力する現象を完全に防ぐことは困難ですが、発生しやすい条件を把握することで、リスクを大幅に軽減できます。

発生しやすい3つの条件

ビジネス現場でAIを活用する際、特に出力結果を警戒すべき領域として、以下の3点が挙げられます。

- ニッチなトピック: 学習データが少ないマイナーな分野や特定の社内用語

- 専門性の高い情報: 医療、法律、金融など、高度な専門知識や正確な数値が求められる分野

- 時事的な内容: AIの学習期間以降に発生した最新のニュースやトレンド

これらの領域に関する出力を得た場合は、ハルシネーションのリスクが高いと判断し、より慎重な確認を行う必要があります。

ツールを活用した具体的な対策

現場でAIを安全に運用するためには、システムが確率的に生成する情報の限界を認識し、適切な対策を講じる必要があります。

具体的な対策として、プロンプトの工夫が挙げられます。ただし「嘘をつかないでください」と直接指示しても効果が薄いため、出力形式や制約条件を具体的に指定することが重要です。実践的なプロンプトの書き方については、AIに「ハルシネーションしないでください」は逆効果!嘘を防ぐプロンプトと8つの対策 や、AIのハルシネーション対策ガイド|原因と誤出力を防ぐ5つのプロンプト事例 を参考にしてください。

また、自社の独自データを参照させるRAG(検索拡張生成)技術を導入することで、外部の不確かな情報ではなく、社内の正確なドキュメントに基づいた回答を生成させることが可能になります。社内データを連携してハルシネーションを防ぐ方法については、【2026年最新】生成AIの社内活用で業務を自動化!社内データ連携と失敗しない導入ステップ7選 にて詳しく解説しています。

AIを業務効率化の強力なパートナーとして活用するためには、こうした技術的な対策と、人間の目による一次情報との照合を組み合わせることが最も確実なリスク対策となります。

ファクトチェックの重要性

AIが事実とは異なる回答をする現象を深く理解するには、ハルシネーションの語源が示す「本人は確信しているが、現実には存在しない」という本質に立ち返ることが有効です。

AIモデルは事実の正確性よりも文章の流暢さを優先して学習しているため、人間から見ると完全に誤った情報であっても、自信満々に回答を生成してしまいます。業務で生成AIを運用する際は、この特性を前提としたリスク管理が不可欠です。

ハルシネーションの語源から導き出される最大の教訓は、「AIは悪意なく流暢な嘘をつく構造になっている」という事実です。現場のDX担当者やマネジメント層は、AIの出力を鵜呑みにせず、必ず人間による事実確認(ファクトチェック)を業務フローに組み込む必要があります。AIはあくまで人間の思考を拡張するツールであり、最終的な品質保証は人間が行うという原則を忘れてはなりません。

まとめ

AIの「ハルシネーション」は、単なる技術的なバグではなく、そのハルシネーションの語源である「幻覚」が示す通り、AIがもっともらしい嘘を自信満々に語る現象です。ビジネスにおいてAIを導入する際は、この特性を深く理解し、適切な対策を講じることが不可欠となります。

本記事で解説した主要なポイントは以下の通りです。

- ハルシネーションの語源は医学・心理学における「幻覚」であり、AIが「本人は確信しているが、現実には存在しない」情報を生成する現象と共通する。

- AIが誤情報を生成する原因は、学習データの不完全さやモデルの構造的な限界にあり、人間のように意味を理解しているわけではない。

- AIの出力は流暢であっても、事実の正確性を保証するものではないため、ビジネス上の意思決定に誤りや損害をもたらすリスクがある。

- AIを安全に活用するためには、出力結果を鵜呑みにせず、必ず人間によるファクトチェックを業務プロセスに組み込むことが最も重要である。

AIは強力なツールですが、その限界を正しく認識し、人間が最終的な責任を持つ運用体制を構築することで、初めてその真価を発揮できるでしょう。

AIで、業務を生まれ変わらせる

Claude Cowork や Cursor のようなエージェント型ツールを業務に組み込み、議事録作成・ドキュメント生成・社内ナレッジ検索・営業資料作成などの業務を自動化。属人化していた仕事をAIで標準化し、組織全体の生産性を底上げします。

藤田智也

生成AIの業務実装コンサルタントとして、これまでに数十社の業務効率化を支援してきました。特にClaudeなどの大規模言語モデルやAIエージェントを活用した、実務に直結するプロンプト設計と仕組み化を得意としています。本メディアでは、現場ですぐに使える具体的なAI活用ノウハウや最新の実践事例をわかりやすく解説します。

関連記事

AIに「ハルシネーションしないでください」は逆効果!嘘を防ぐプロンプトと8つの対策

AIに「ハルシネーションしないでください」と指示すると、かえって嘘をつく確率が高まることをご存知ですか?本記事では、ChatGPTなどがハルシネーションを起こす理由を解説し、事実に基づく回答を得るための具体的なプロンプト例や、RAGによる外部連携など8つの実践的な対策を徹底解説します。

【2026年版】生成AI活用のおすすめ本・書籍と仕事で役立つ資格3選

生成AIのビジネス活用スキルを体系的に学びたい方向けに、2026年最新の役立つ資格試験とおすすめの書籍を厳選して紹介します。自社のDX推進担当者のスキルアップや、社内研修の教材選びに迷っている方は必見です。

【2026年版】総務省の生成AIガイドライン解説|AIリスク4分類と社内ルールのサンプル

総務省やデジタル庁が発表している生成AIガイドラインの要点をビジネスパーソン向けに徹底解説。総務省が提唱する「AIリスク4分類」に基づく企業側の具体的な対応手順と、現場ですぐに使える社内利用ガイドラインのサンプルを整理しました。

AIのハルシネーション対策ガイド|原因と誤出力を防ぐ5つのプロンプト事例

生成AIが事実と異なる嘘をつく「ハルシネーション」の原因と、出力を正確にコントロールする5つの実践的な対策プロンプトを紹介。リスクを抑えてAIを安全に業務活用するための必読ガイドです。

AnthropicのClaude Mythosとは?未公開AIの全貌と一般公開されない理由

2026年4月にAnthropicが発表した未公開の最上位AI「Claude Mythos(クロード ミュトス)」。その驚異的なサイバーセキュリティ能力と、なぜ「神話」という名が冠されたのか、語源や読み方からAIの未来を考察します。

【2026年版】生成AI利用ガイドラインの作り方|企業向けサンプルひな形と7つの対策

企業で生成AIを安全に導入するために不可欠な「社内利用ガイドライン」。この記事では、2026年の最新の法的リスクに対応したルール策定のステップと、自社ですぐにカスタマイズして使える実践的なサンプルひな形を公開します。