【2026年版】AI著作権の基本ルール|生成AIのリスク問題と企業が取るべき5つの対策

企業の生成AI活用における著作権侵害リスクに悩んでいませんか?2026年最新の法解釈やガイドラインに基づき、企業が情報発信等で安全にAIを活用するための「AI著作権の基本ルール」と、問題発生を未然に防ぐ5つの具体的な対策を解説します。

AI生成物を業務で利用する際、著作権侵害を回避する最大のポイントは、既存の著作物との「類似性」と「依拠性」を排除することです。日本の著作権法では、AIにデータを読み込ませる学習段階は原則第30条の4により適法ですが、生成物を公開する利用段階では通常の著作権侵害と同じ基準で判断されます。

2024年3月に文化庁が公表した「AIと著作権に関する考え方について」、同年7月の「AIと著作権に関するチェックリスト&ガイダンス」、2025年3月改訂の「AI事業者ガイドライン(第1.1版)」(経済産業省・総務省)と、企業が踏まえるべき公的指針は2024年から2025年にかけて整備されました。2025年8月には読売新聞・朝日新聞・日本経済新聞が生成AI事業者を提訴するなど、企業の著作権リスクは現実化しています。

本記事では、この最新動向を踏まえ、企業が情報発信で侵害リスクを回避するための5つの具体的な対策を解説します。

AI著作権の基本:学習段階と利用段階の違い

日本の著作権法第30条の4では、情報解析を目的としたAIの機械学習において、原則として著作権者の許諾なく既存の著作物を利用できると定められています。AIにデータを読み込ませる「学習段階」では、著作権侵害に問われるリスクは低いといえます。

ただし第30条の4には「ただし書」があり、文化庁の「AIと著作権に関する考え方について」(2024年3月)では、著作物の表現を享受する目的が併存する場合や、著作権者の利益を不当に害する場合は適用外と整理されています。具体的には、有償提供されているデータベースを情報解析目的で許諾なく複製する行為などが該当します。

業務でAIが生成したテキストや画像を外部へ公開する「利用段階」においては、通常の著作権侵害と全く同じ基準で判断されます。これが、企業がAIの著作権リスクを評価する上で最も注意すべきポイントです。社内ガバナンスと安全運用を整える観点では、AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順 も参考にしてください。

生成AIの出力物に著作権は認められるか?

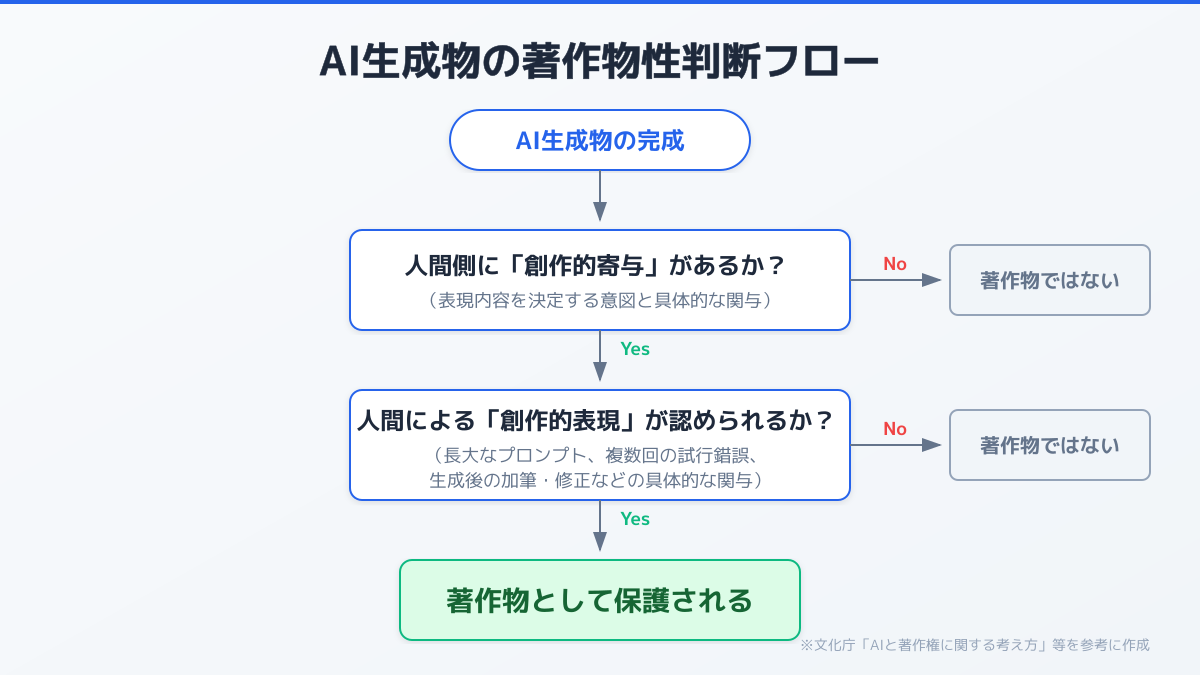

AIを利用して生成したコンテンツを自社の情報発信に用いる際、その生成物自体に著作権が発生するかが問題となります。文化庁の「AIと著作権に関する考え方について」では、AIの生成物が著作物と認められるかは、人間の「創作的寄与」があったかどうかが鍵とされています。

単に短いプロンプトを入力しただけでは著作物とは認められにくく、出力結果に対して人間が意図的な加筆・修正を行うなどのプロセスが必要です。出力されたベースラインに対して、担当者が独自の考察を加えたり、大幅な加筆修正を行ったりすることで、初めて自社の著作物として認められる可能性が高まります。

逆に「創作的寄与」が乏しい生成物は、第三者が利用しても自社の著作権侵害として権利主張しにくくなる点も実務上の注意点です。

AIの著作権問題となる「類似性」と「依拠性」の判断基準

生成AIの出力物が第三者の著作権を侵害しているかどうかは、通常の著作権侵害と同様に「類似性」と「依拠性」という2つの軸で判断されます。

- 類似性:AIが生成したコンテンツが既存の著作物と同一、あるいは表現上の本質的特徴が共通していること

- 依拠性:既存の著作物を認識し、それをもとに作成したこと

文化庁の整理では、特定の作家名・既存作品名・特定キャラクターを指示するプロンプトを入力した場合や、特定作品で追加学習(LoRA等)したモデルを利用した場合は、依拠性が認められやすいとされています。結果として出力されたものが既存作品と類似していれば、企業としての情報発信が著作権侵害に問われ、損害賠償や配信停止の措置を受けるおそれがあります。

実際、2025年8月には読売新聞社が約21億6,800万円、朝日新聞社・日本経済新聞社がそれぞれ約44億円の損害賠償を求めて生成AI検索サービスの事業者を提訴しており、企業利用者側にも波及するリスクが高まっています(出典:日本経済新聞「生成AIの権利侵害『現在も止まらず』」)。

生成AIの著作権リスクを回避する企業対策5選

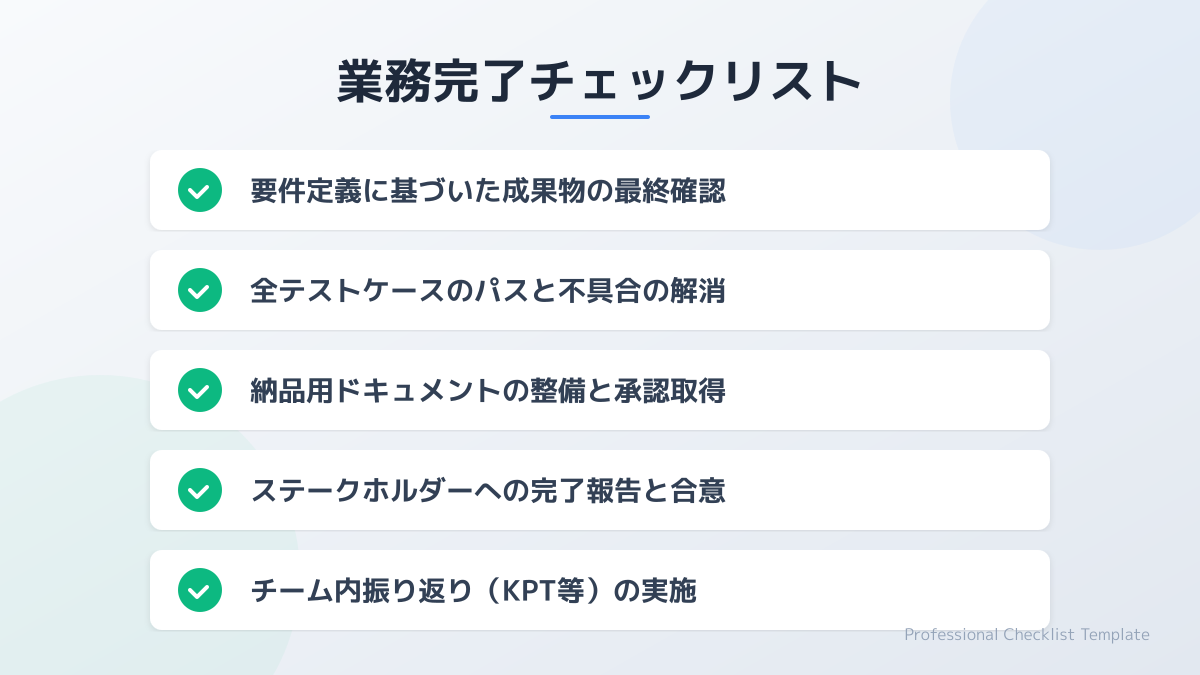

企業が生成AIを安全に活用するためには、個人のリテラシーに依存しない組織的な運用体制の構築が不可欠です。文化庁「AIと著作権に関するチェックリスト&ガイダンス」(2024年7月)が示すAI利用者(業務)向けの取組を踏まえ、現場で実装しやすい5つの対策を解説します。

1. プロンプト入力時のルール徹底

どのような指示を与えて生成したか、他者の著作物を入力していないかを履歴として残すことが重要です。特定の固有名詞や既存の作品名をプロンプトから除外するルールを設けましょう。

- NGな入力:「〇〇(有名作家)の文体でキャッチコピーを考えて」

- OKな入力:「親しみやすく、説得力のあるトーンでキャッチコピーを考えて」

特定キャラクターを再現しようとする指示や、特定作品を学習したカスタムモデル(LoRA等)の業務利用は、文化庁ガイダンスでも依拠性が高まる類型として注意喚起されています。

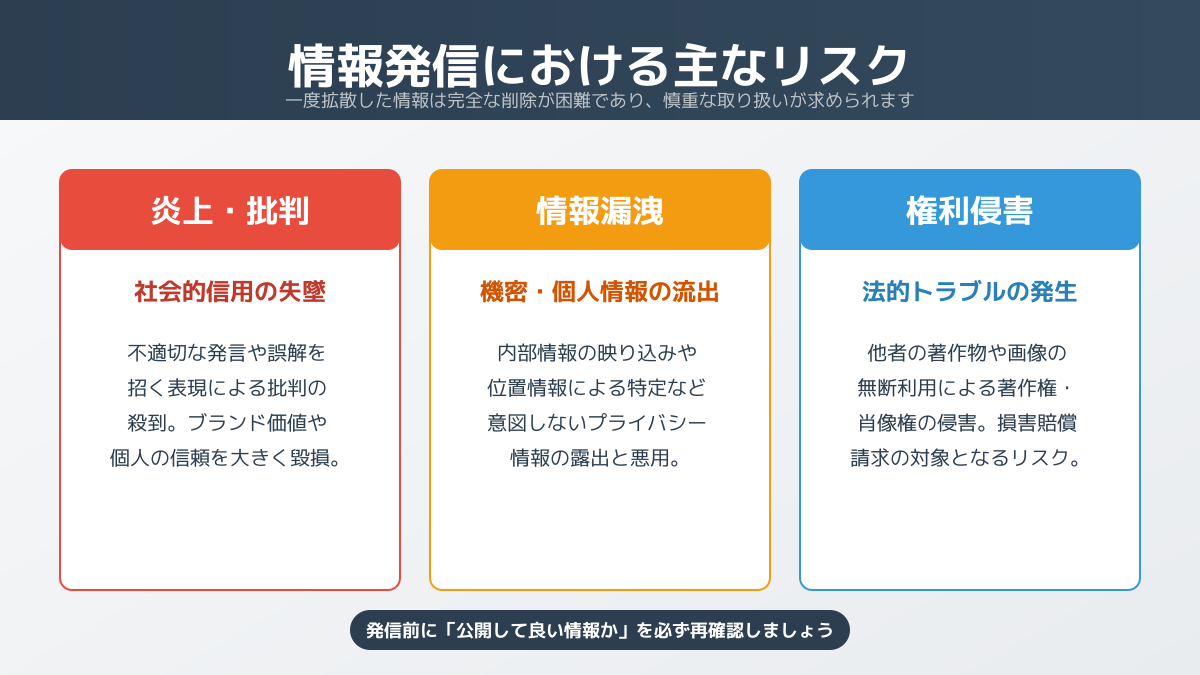

2. 公開前の類似性チェックとファクトチェック

AIの出力物をそのまま外部へ公開することは避けてください。出力されたテキストはコピペチェックツールにかけ、画像は逆画像検索などを用いて既存の作品と類似していないかを確認する手順を標準化します。

- 具体例:記事を公開する前に、無料のテキスト一致率チェックツールを通し、既存のウェブコンテンツとの一致率が規定値(例:40%)未満であることを確認する運用フローを設けます。

- 画像:Google レンズや TinEye 等の逆画像検索で類似画像が出ていないかを確認し、特定キャラクターと混同されうる出力は差し替えます。

3. 人間による加筆修正の義務化

AIの出力物を下書きとして扱い、必ず担当者が独自の視点や情報を加筆して最終的なコンテンツに仕上げます。これにより、意図しない著作権侵害のリスクを軽減しつつ、文化庁が言う「創作的寄与」を満たして自社の著作物としての価値を高めることができます。

4. 社内ガイドラインの策定と周知

利用可能なAIツールの指定、入力してはいけない機密情報や他者の著作物の定義、そして公開前の承認フローを明記したガイドラインを策定します。全社員で共有し、日々の業務プロセスに組み込むことが重要です。

- ガイドラインに含める項目のサンプル:

- 会社が公式に許可したAIツールのリスト(法人向け契約・学習オプトアウト設定済みのプラン)

- 顧客の個人情報、未公開の自社機密データ、他社の著作物をプロンプトに入力することの禁止

- AIを利用して作成したコンテンツを外部公開する際の、管理職による事前承認フロー

社内ガイドラインのテンプレートが必要な場合は、生成AI利用ガイドラインの作り方|企業向けサンプルひな形と7つの対策 のひな形をベースに、自社の業務に合わせてカスタマイズすると着手しやすいです。

5. 法改正や最新判例の継続的なモニタリング

AI技術と関連する法解釈は日々アップデートされています。一度ルールを定めて終わりにするのではなく、最新のガイドラインに合わせて社内規定を定期的に見直す体制を整えましょう。

特に押さえておくべき公的指針は次の通りです。

- 文化庁「AIと著作権に関する考え方について」(2024年3月15日)

- 文化庁「AIと著作権に関するチェックリスト&ガイダンス」(2024年7月31日)

- 経済産業省・総務省「AI事業者ガイドライン(第1.1版)」(2025年3月28日改訂)

- EU AI法(2026年8月2日全面施行、域外適用あり)

EU向けにサービスを提供する企業は、EU AI法の影響も無視できません。詳しくは EU AI法とは?罰金7%・リスク4分類・日本企業への影響を5分で解説 を参照してください。

まとめ

本記事では、生成AIの活用が広がる現代において、企業が直面する生成AIと著作権のリスクと、それを回避するための具体的な対策について解説しました。AIの学習段階と利用段階の違いを理解し、類似性・依拠性の判断基準を押さえることが安全な情報発信の第一歩です。

2024年から2025年にかけて文化庁・経済産業省・総務省が公的指針を整え、2025年8月には大手新聞社による生成AI事業者の提訴も起きました。企業は、プロンプト入力のルール化や公開前のチェック体制の構築など、5つの対策を組織全体で徹底することが求められます。継続的なリスク管理を行うことで、企業はAI技術の恩恵を最大限に享受しながら、法的なトラブルを未然に防ぐことができるでしょう。

なお、本記事は一般的な解説であり、具体的な事案については弁護士等の専門家に相談することを推奨します。