【2026年版】企業が直面するAI倫理の問題点とは?AI倫理ガイドライン策定の3ステップ

AI事業者ガイドライン第1.2版の公表とEU AI法の本格適用が迫るなか、企業のAI倫理対応は待ったなしです。情報漏洩・著作権・アルゴリズムバイアスなど代表的な倫理問題を実例とともに整理し、社内ガイドライン策定からガバナンス構築までの3ステップを解説します。

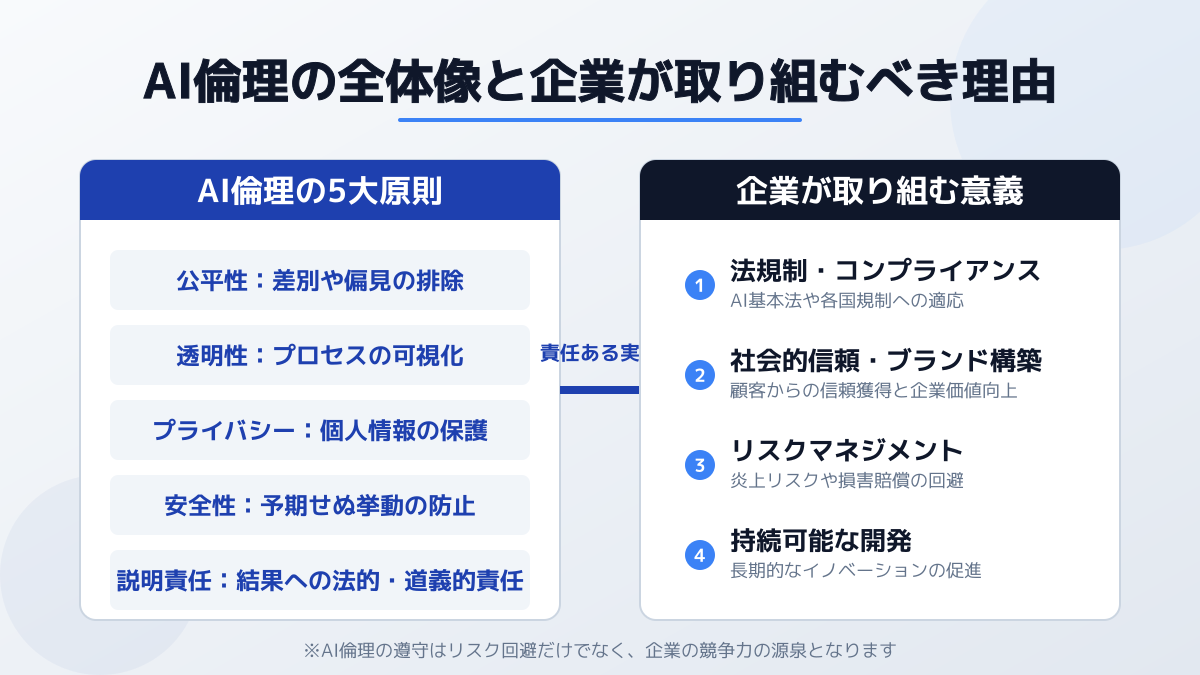

AI事業者ガイドライン第1.2版(2026年3月31日公表)とEU AI法の本格適用(2026年8月2日)が迫るなか、企業のAI倫理対応は経営課題に格上げされました。情報漏洩や著作権侵害、アルゴリズムの偏見といった倫理リスクは、対応を誤れば事業停止や巨額の制裁金にも直結します。本記事では、企業が直面するAI倫理の問題点を実例ベースで整理し、ガイドライン策定から社内浸透、ガバナンス構築までの実践的な3ステップを解説します。

企業が直面するAI倫理の4つの問題点

AIを業務に導入する際、企業が直面するAI倫理の問題点は大きく4つに分類されます。実例とともにリスクを正しく認識し、現場で機能するルールを設計するための前提知識として押さえておきましょう。

1. 情報漏洩とプライバシー侵害

悪意のない従業員による情報漏洩は最も発生頻度の高い倫理リスクです。代表的な事例として、サムスン電子では2023年3月にDS(Device Solution)部門でChatGPTの社内利用を許可してから約20日間で、半導体設備のソースコードや社内会議の議事録を入力する3件の機密情報漏洩が発生しました。サムスンはこの後、ChatGPTへのアップロードを1質問あたり1,024バイトに制限する措置を取っています。

顧客データの処理においても、本人の同意を得ずにAIに入力することは個人情報保護法違反となる可能性があります。生成AIサービスの多くは入力データを学習に再利用する規約となっているため、機密情報をそのまま投入する運用は重大なプライバシー侵害につながります。

2. 著作権・知的財産の侵害

生成AIが出力した文章や画像が、既存の著作物と類似してしまうケースが後を絶ちません。他社の著作物をプロンプトに入力することや、生成物をそのまま自社のオリジナルコンテンツとして公開することは、著作権侵害のリスクを伴います。

文化庁が2024年3月に公表した「AIと著作権に関する考え方」では、AI生成物が既存著作物に依拠していると判断される場合、商用利用は侵害に該当しうると明記されています。法務部門による事前チェックを業務フローに組み込む必要があります。

3. アルゴリズムの偏見・差別

AIの学習データに偏りがある場合、採用活動や与信審査において特定の属性に対する不当な評価を下す危険性があります。代表事例として、Amazonは2014年から2017年まで開発していたAI採用ツールを、女性応募者を不当に低く評価するバイアスが除去できないと判断して廃止しました。過去10年分の応募データが男性中心だったことが原因で、「women's」という単語や女子大の名称が含まれる履歴書を低く採点する挙動が確認されています。

4. 透明性と説明責任の欠如

AIの判断プロセスがブラックボックス化すると、なぜその結果に至ったのかを顧客やステークホルダーに説明できなくなります。特に金融や医療、人事評価など、人命や財産・キャリアに関わる分野では致命的な問題点となります。

EU AI法では、ハイリスクAIシステムに対して説明可能性(Explainability)と人間による監視(Human Oversight)を義務化しており、2026年8月2日からはこれらの規定が全面適用されます。日本企業もEU域内でAIサービスを提供する場合は対応が必須です。

押さえるべきAI倫理の国際的フレームワーク

ガイドライン策定の前提として、企業が参照すべき主要なフレームワークを整理します。すべてを網羅する必要はありませんが、自社のリスク領域に応じて取捨選択することが重要です。

- AI事業者ガイドライン第1.2版:総務省・経済産業省が2026年3月31日に公表した日本の中核的指針。AIエージェントとフィジカルAIへの対応が新規追加され、外部システムへ自律的に作用するAIエージェントには「Human-in-the-Loop(人間の判断介入)」の実装が要求されます。

- EU AI法(EU AI Act):2024年8月発効、2026年8月2日から全面適用。違反時の制裁金は最大で全世界年間売上高の7%または3,500万ユーロのいずれか高い方。

- OECD AI原則:2019年採択、2024年5月に改訂。生成AIの普及を踏まえ、偽情報対策と知的財産権保護を強化。日本含む加盟38カ国+8カ国が支持。

- UNESCO AI倫理勧告:2021年11月に全加盟193カ国が満場一致で採択。透明性・説明責任・人権保護を中心に据えた国際規範。

- 広島AIプロセス国際行動規範:G7が策定した先進AI開発組織向けの行動規範。2025年2月から「報告枠組み」がOECDウェブサイトで正式運用開始。

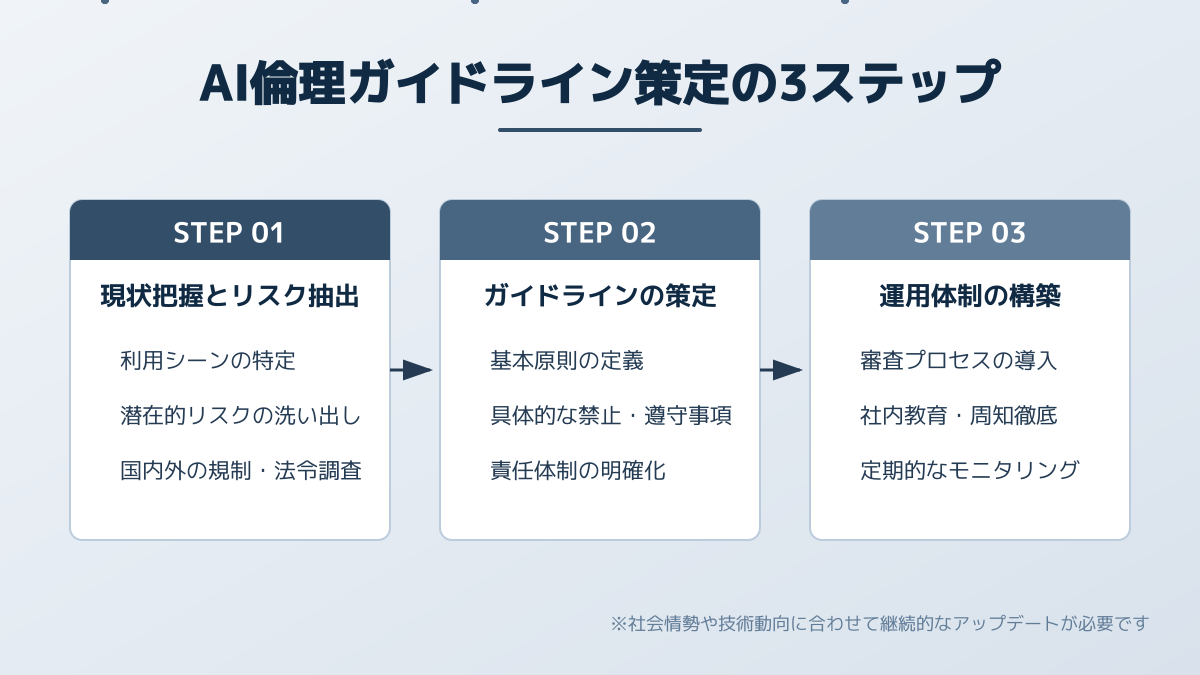

AI倫理ガイドライン策定から運用の3ステップ

前述した問題点を防ぎつつ生産性向上を実現するためには、明確な社内ルールである「AI倫理ガイドライン」の策定が不可欠です。ここでは、ガイドライン策定からガバナンス体制構築までの3ステップを具体例とともに解説します。

ステップ1:自社に合わせたガイドラインの策定(サンプル)

まずは、利用可能な業務範囲と入力データの制限を明確に定義します。アイデア出しや公開情報の要約など、AIを利用してよいプロセスを特定し、禁止事項を明文化します。

【AI倫理ガイドラインの項目サンプル】

- 利用可能なAIツール: 会社が許可した法人向けアカウント(例:Claude Enterprise、ChatGPT Enterprise、Microsoft 365 Copilot など、入力データを学習に再利用しない契約のもの)のみ利用すること。無料版や個人アカウントの業務利用は原則禁止とする。

- 入力データの制限: 顧客の個人情報、未公開の財務情報、社外秘のソースコード、人事評価データをプロンプトに入力してはならない。

- 出力結果のファクトチェック: AIの生成物にはハルシネーション(もっともらしい嘘)が含まれる可能性があるため、必ず人間が事実確認を行うこと。AIの出力をそのまま外部公表しない。

- 著作権の尊重: 他者の著作物をそのまま入力しない。生成された画像や文章を商用利用する際は、既存の著作権を侵害していないか法務部門に確認すること。

- AIエージェントの監督: 外部システムに自律的に作用するAIエージェント(メール送信・データ更新・取引実行など)には、リスクに応じた人間の承認プロセスを必ず組み込むこと(AI事業者ガイドライン第1.2版に準拠)。

ガイドライン策定の具体的な項目とテンプレートは 【2026年版】生成AI利用ガイドラインの作り方|企業向けサンプルひな形と7つの対策 も併せてご確認ください。

ステップ2:社内への周知と実践的な教育

ガイドラインを策定しただけでは形骸化してしまいます。イントラネットでの通達だけでなく、研修やワークショップを通じて従業員の理解を深めることが重要です。

実際の業務シナリオを想定したワークショップを行うことで、従業員は「自分の業務において何がリスクになるのか」を自分事として捉えられます。技術者と非技術者それぞれに求められる倫理的観点を分け、適切な教育プログラムを提供しましょう。

サムスンの事例のように、利便性を求めた現場判断が大規模な情報漏洩につながるパターンは典型的です。事例ベースの研修で「なぜ禁止なのか」まで腹落ちさせることがポイントになります。情報漏洩リスクの詳細と具体的な対策は 【2026年版】生成AIの情報漏洩リスクとは?サムスン3件流出に学ぶ5つの対策と実例 を参考にしてください。

ステップ3:AI倫理委員会の設置とガバナンス構築

教育と並行して、ガイドラインの運用を継続的に監視・評価するガバナンス体制を作ります。AI技術の進化は速く、一度定めたルールがすぐに陳腐化するリスクがあるためです。

先進的な企業では、経営陣や事業部門から独立した「AI倫理委員会」を設置しています。例えばソフトバンク株式会社は2024年4月に常務執行役員兼CISOを委員長とし、AI倫理・データガバナンス・法律・ESGなど多分野の社外有識者5名と社内委員5名による「AI倫理委員会」を設立し、客観的かつ実効性の高いAIガバナンスを実現しています。

中小企業の場合、大規模な委員会を設置できなくても、経営者・法務担当・現場責任者の3名程度でルール見直しの定例会を設けるだけでも十分なガバナンス効果が期待できます。

現場の従業員向けには、プロジェクト企画時に利用できる「倫理チェックシート」を配布し、日常業務のなかで自己判断できる仕組みを整えることも有効です。AIガバナンスの体制構築をより詳しく知りたい場合は 【2026年版】AIガバナンスとは?生成AI導入の失敗を防ぐ企業向けガイドラインと6つの手順 も参考になります。

よくある質問

AI倫理ガイドラインの対象者は誰ですか?

正社員だけでなく、契約社員や業務委託、インターンなど、自社の業務でAIツールにアクセスするすべてのスタッフが対象となります。委託先がAIを利用する場合は、契約書に倫理ガイドライン遵守を明記しておくと安全です。

中小企業でもAI倫理委員会は必要ですか?

大規模な委員会を設置しなくても、経営者・法務担当・現場責任者の3名程度で四半期ごとにルールを見直すミーティングを設けるだけでも、十分なガバナンス効果が期待できます。

EU AI法は日本の中小企業にも関係ありますか?

EU域内の顧客にAIサービスや製品を提供する場合は、企業規模を問わず適用対象となります。直接の取引がなくても、サプライチェーンの上流企業がEU法対応を求めてくるケースが増えているため、一定の備えが必要です。

AI事業者ガイドライン第1.2版の主な変更点は何ですか?

AIエージェントとフィジカルAIが正式に対象として明記され、外部システムへ自律的に作用するAIエージェントには「Human-in-the-Loop」の実装が要求されました。リスクの大きさに応じた段階的な監督設計が許容されており、すべての操作に人間承認を要するわけではない点もポイントです。

まとめ

AIの普及に伴い、企業は情報漏洩や著作権侵害、アルゴリズムの偏見、説明責任の欠如といった多岐にわたるAI倫理の問題点に直面しています。AI事業者ガイドライン第1.2版の公表とEU AI法の本格適用を控え、対応の遅れは事業継続そのものを揺るがしかねません。

これらのリスクを管理し、安全に活用するためには以下の3ステップが重要です。

- ステップ1: 入力制限・ファクトチェック義務・AIエージェントの監督要件を明文化したAI倫理ガイドラインの策定

- ステップ2: ガイドラインを形骸化させないための事例ベースの社内研修とワークショップの実施

- ステップ3: AI倫理委員会などガイドラインを継続的にアップデートし監視するガバナンス体制の構築

これらのステップを踏むことで、企業はAIの利便性を最大限に享受しつつ、社会的信頼を維持しながら持続的な成長を実現できるでしょう。